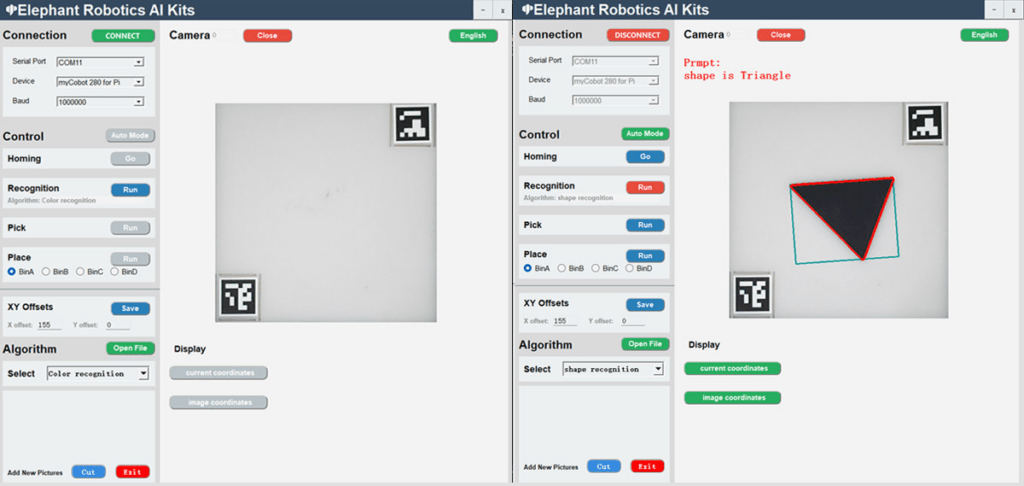

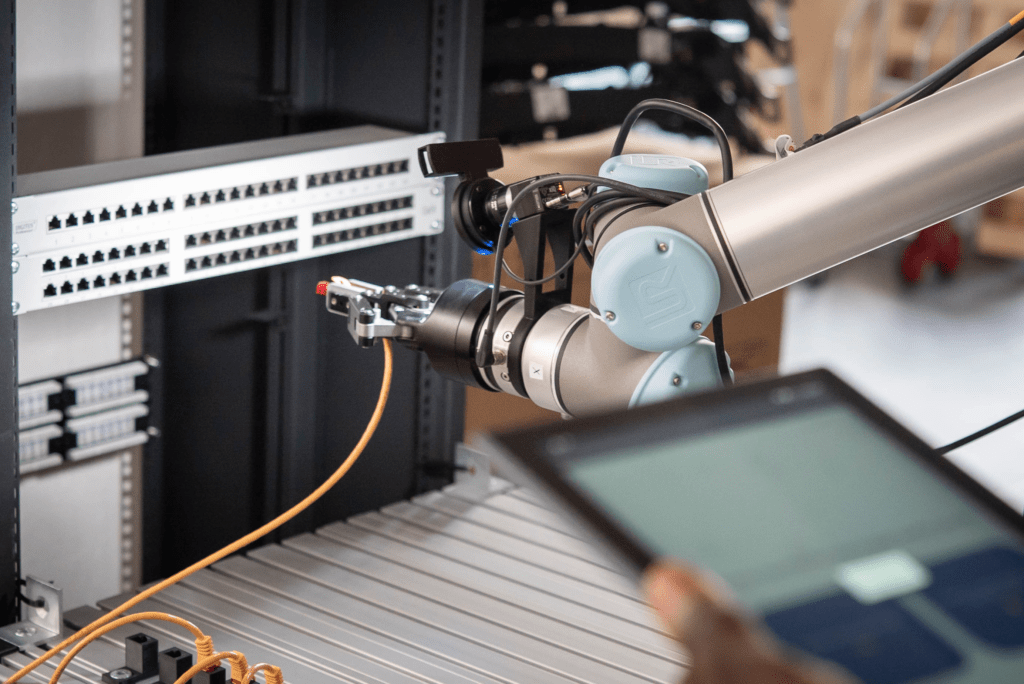

In the past year, Elephant Robotics has launched various products to meet more user needs and help them unlock more potential in research and education. To help users learn more knowledge about machine vision, Elephant Robotics launched the AI Kit, which can work with multiple robotic arms to do AI recognition and grabbing. In June 2022, Elephant Robotics released the mechArm to help individual makers and students get better learning in industrial robotics.

Nowadays, robotic arms are used in an increasingly wide range of applications, such as industry, medicine, commercial exhibitions, etc. At the very end of 2022, ultraArm is launched, and this time, Elephant Robotics doesn’t just release a new robotic arm, but brings 5 sets of solutions to education and R&D.

Small but powerful

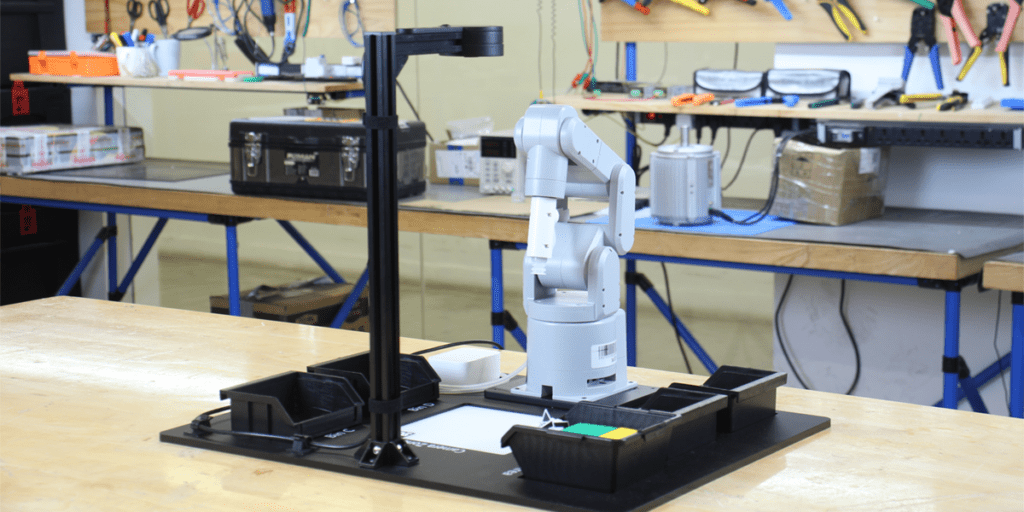

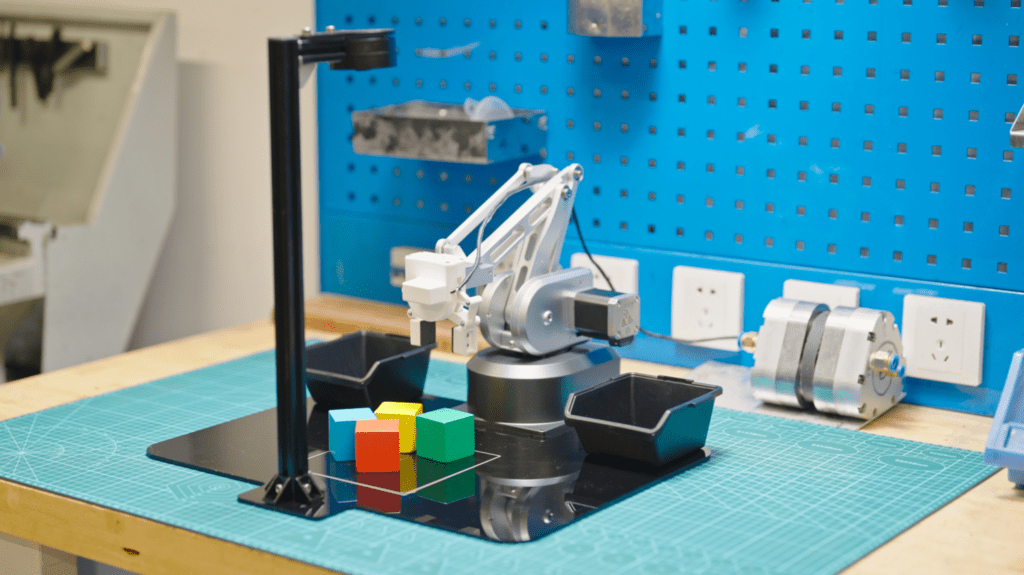

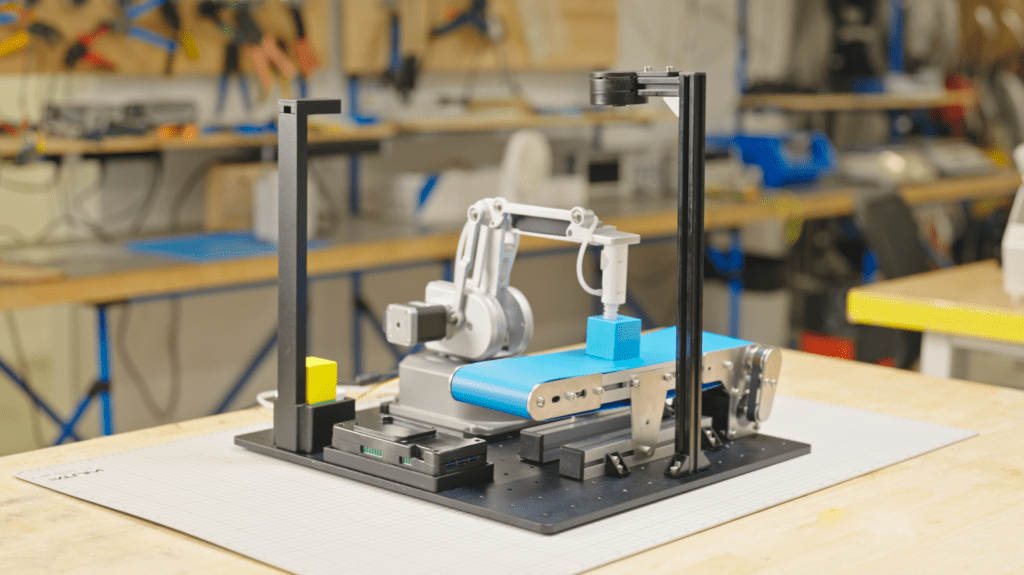

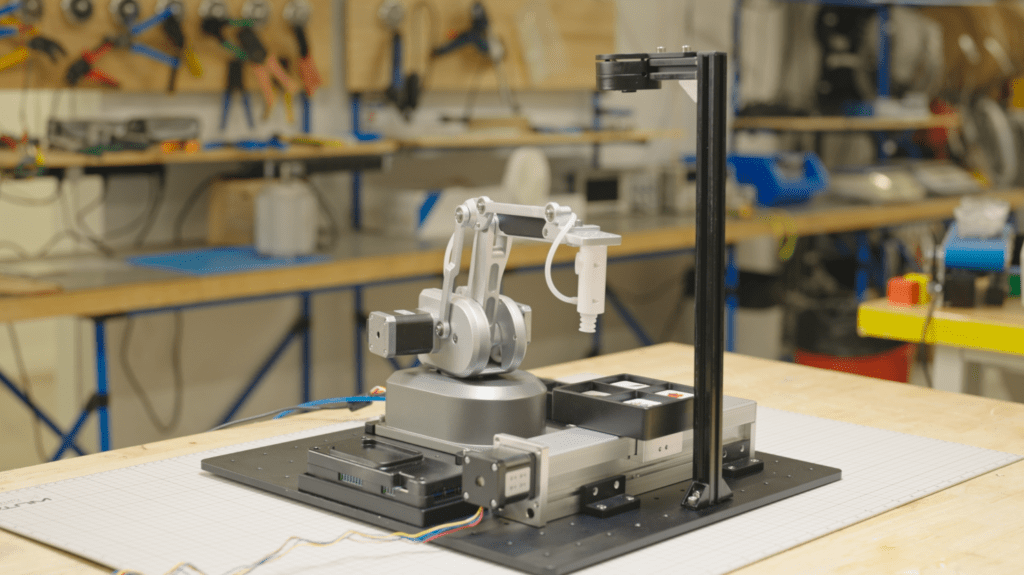

As the core product of this launch, ultraArm is a small 4-axis desktop robotic arm. It is designed with a classic metal structure and occupies only an area of A5 paper. It is the first robotic arm equipped with a high-performance stepper motors of Elephant Robotics. It is stable and owns ±0.1mm repeated positioning accuracy. What’s more, ultraArm comes with 5 kits together including slide rail, conveyor belt, and cameras.

Multiple environments supported

As a preferred tool for the education field, ultraArm supports all major programming languages, including Python, Arduino, C++, etc. Also, it can be programmed in Mac, Windows, and Linux systems. For individual makers who are new to robotics, they can learn robotic programming with myBlockly, a visualization software that allows users to drag and drop code blocks.

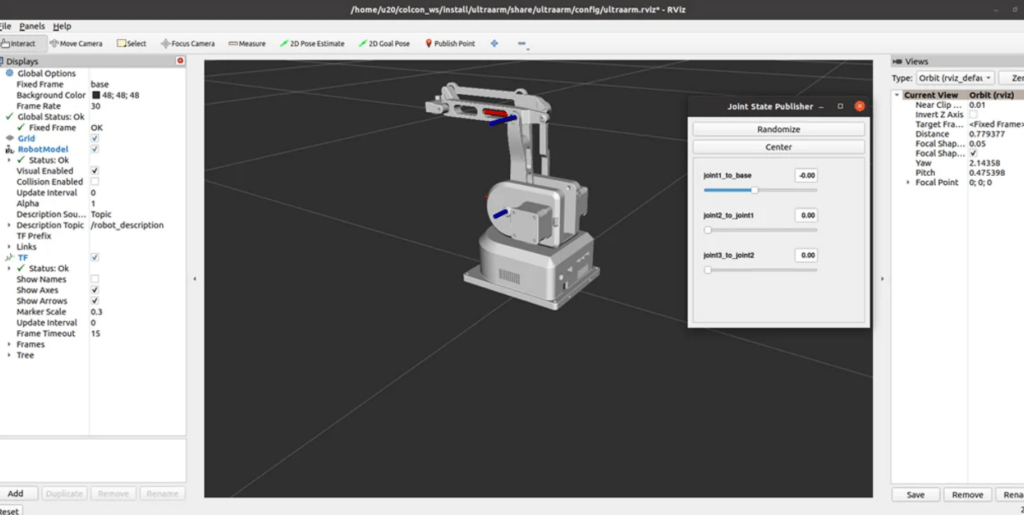

Moreover, ultraArm supports ROS1 & ROS2. In the ROS environment, users can control ultraArm and verify algorithms in the virtual environment, improving experiment efficiency. With the support of ROS2, users can achieve more functions and objects in the developments.

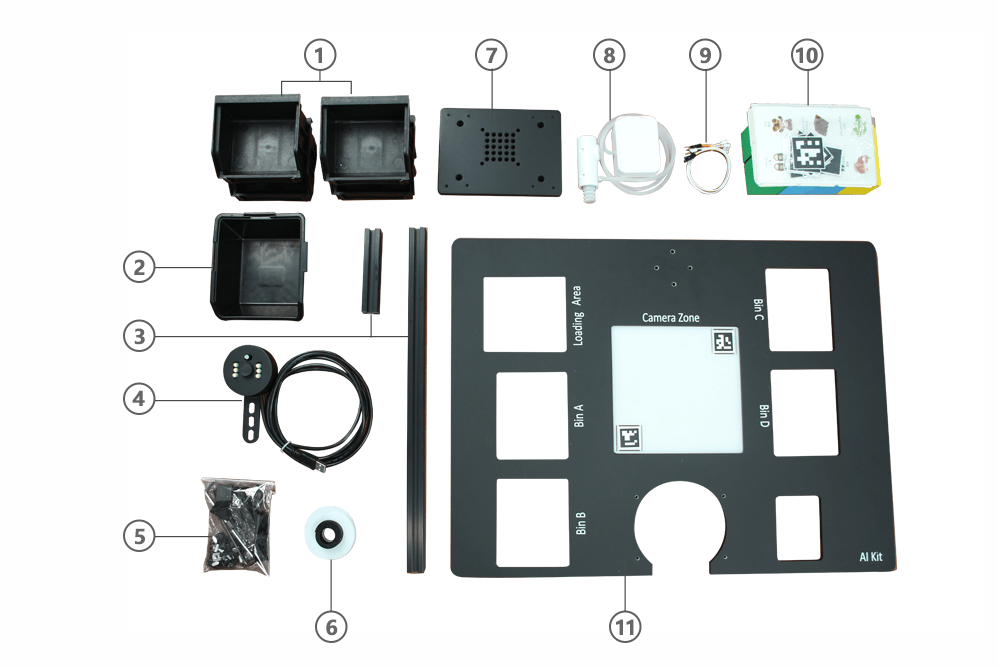

Five robotic kits with for Robot Vision & DIY

In the past year, Elephant Robotics found that many users have to spend large amount of time creating accessories or kits to work with robotic arms. Therefore, to provide more solutions in different fields, ultraArm comes with five robotic kits, which are devided into two series: vision educational kits and DIY kits. These kits will help users, especially students program easily for a better learning experience on practical exercises about AI robot vision and DIY robotic projects.

Vision educational kits

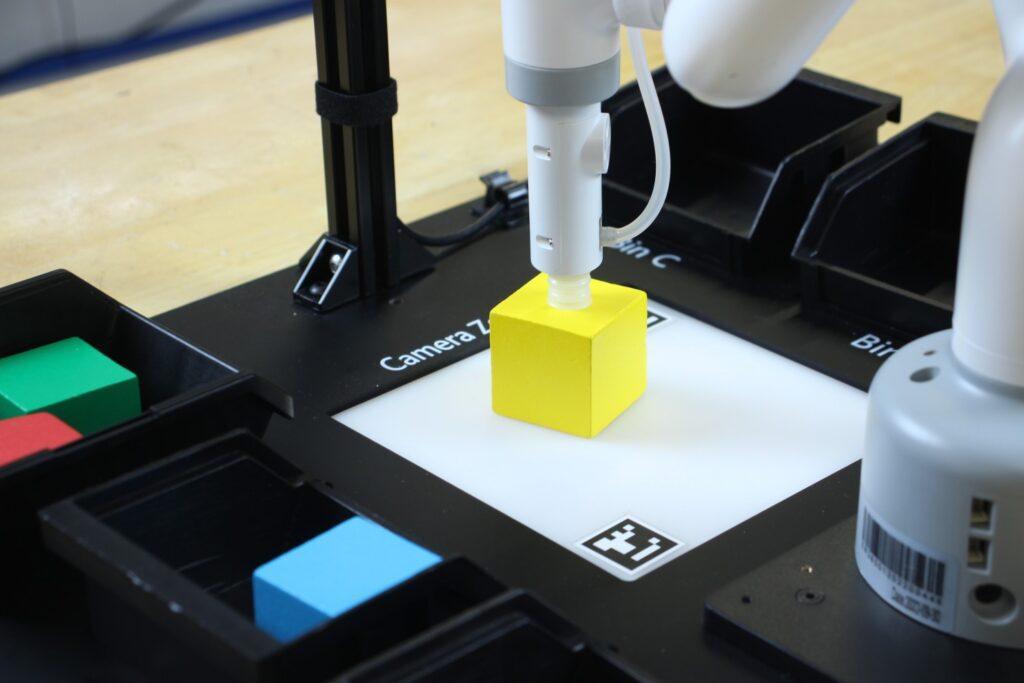

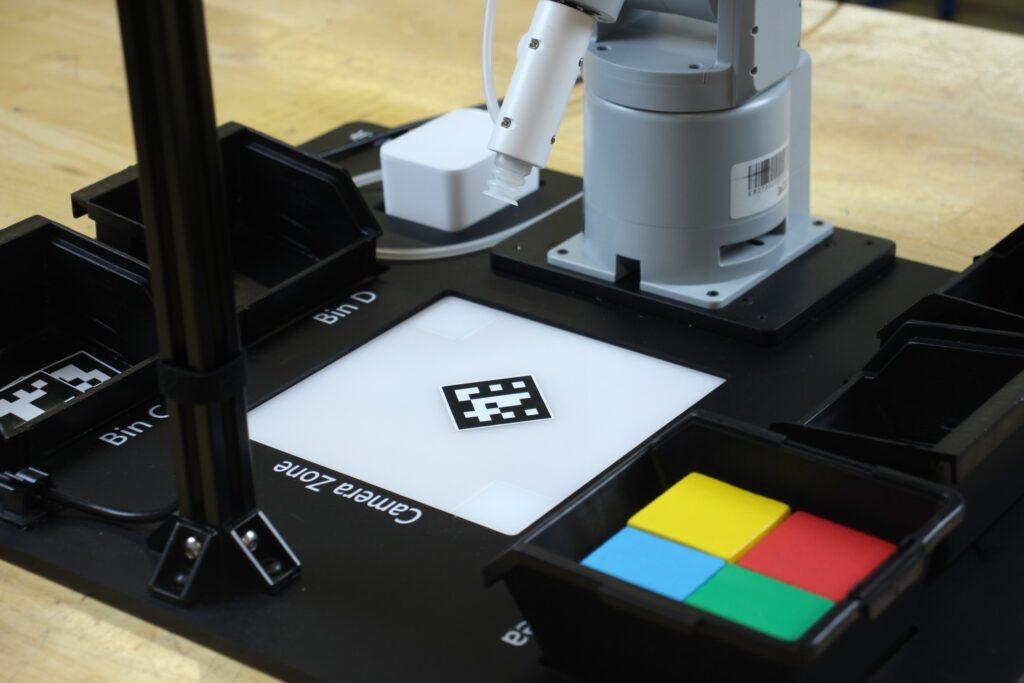

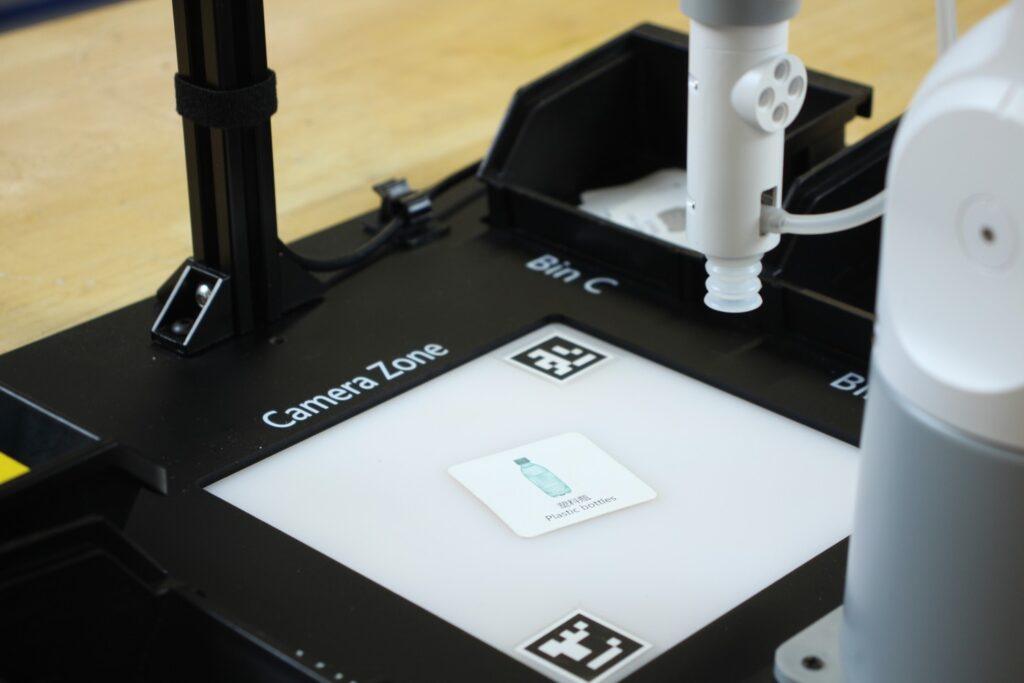

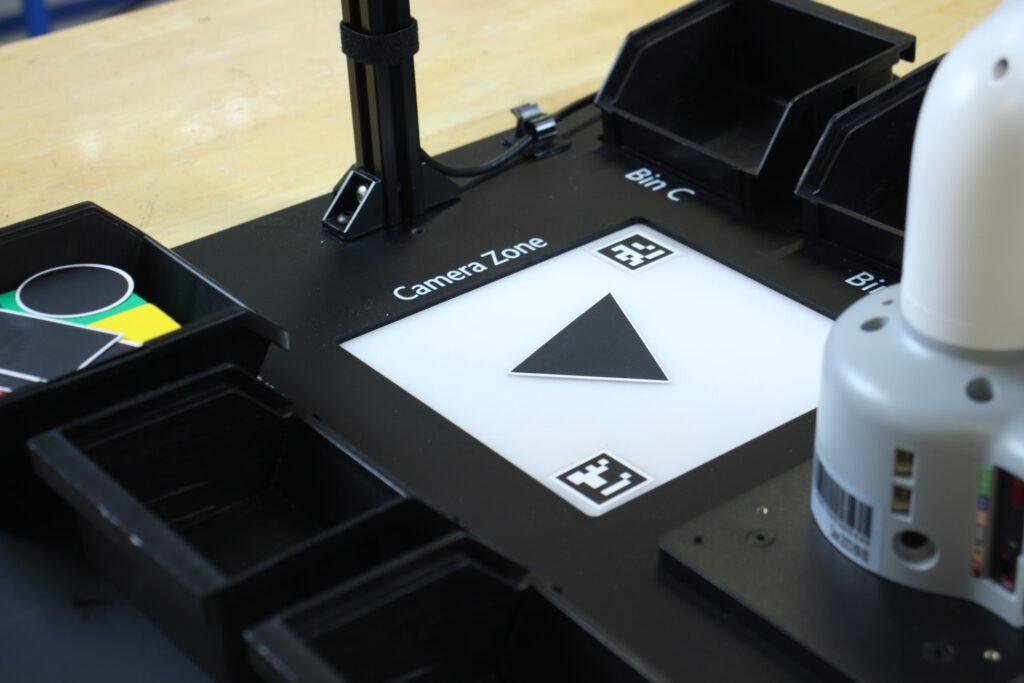

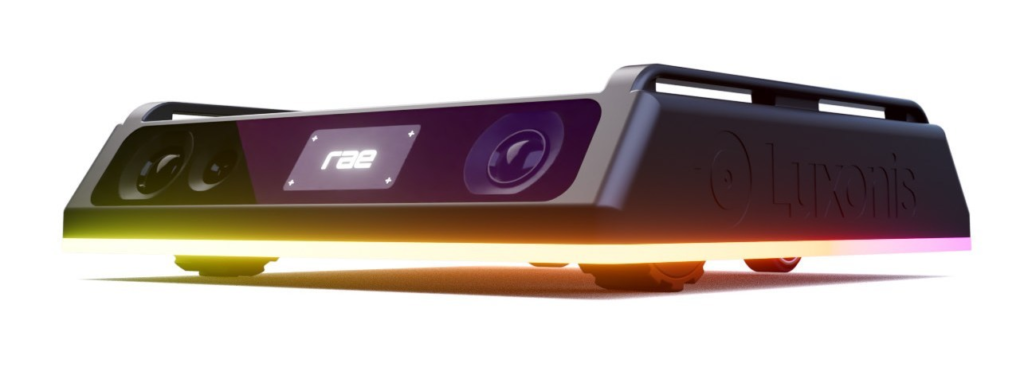

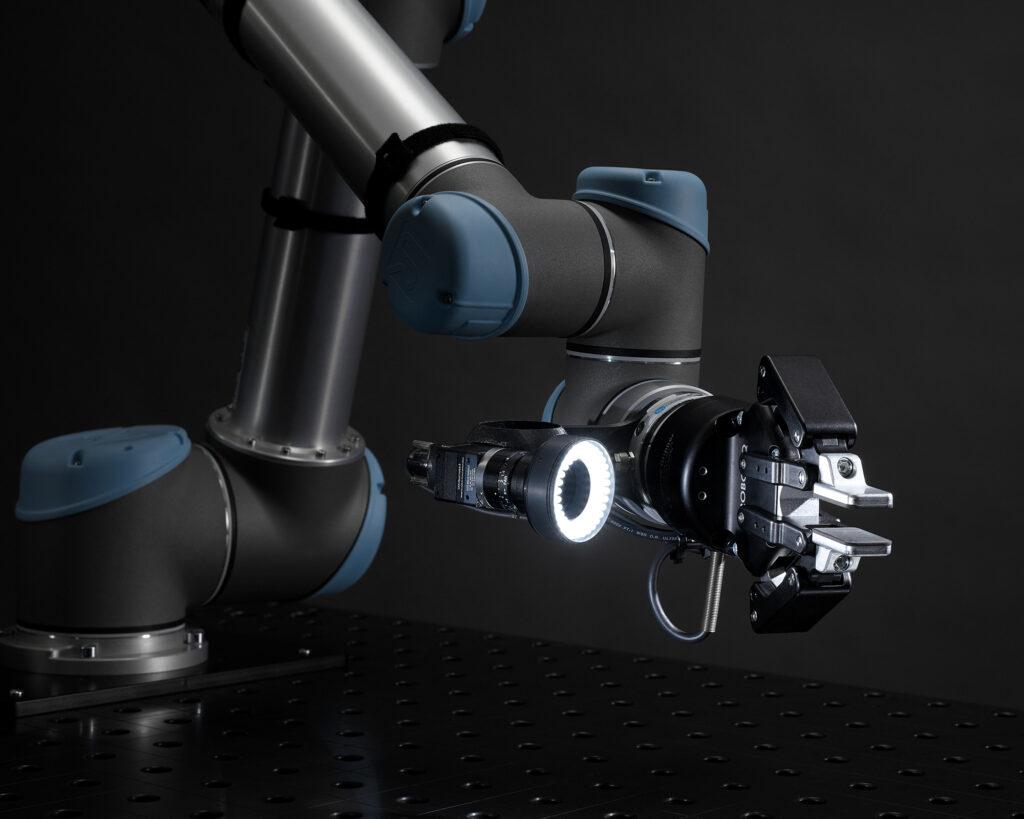

Combined with vision functions, robotic arms can be used for more applications in industry, medicine, education, etc. In robotics education, collaborative robotic arms with vision capabilities allow students to better learn about artificial intelligence. Elephant Robotics has launched three kits for machine vision education: Vision & Picking Kit, Vision & Conveyor Belt Kit, and Vision & Slide Rail Kit to provide more choices and support to the education industry. With the camera and built-in related AI algorithms (Yolo, SIFT, ORB, etc.), ultraArm can achieve different artificial intelligence recognition applications with different identifying ways. Therefore, users can select the kit based on their needs.

For Vision & Picking Kit, users can learn about color & image recognition, intelligent grasping, robot control principle, etc. For Vision & Conveyor Belt Kit and Vision, the robotic arm can sense the distance of materials for identifying, grabbing, and classifying the objects on the belt. Users can easily create simulated industrial applications in this kit, such as color sorting. Users can have deeper learning in machine vision with the Vision & Slide Rail Kit because the robot can track and grab objects through the dynamic vision algorithm in this kit. With the multiple programming environments supported, the vision educational kits are preferred for school or STEM education production line simulation. Moreover, Elephant Robotics also offers different educational programs for students and teachers, to enable them to better understand the principles and algorithms of robot vision, helping them operate these robot kits more easily.

DIY kits

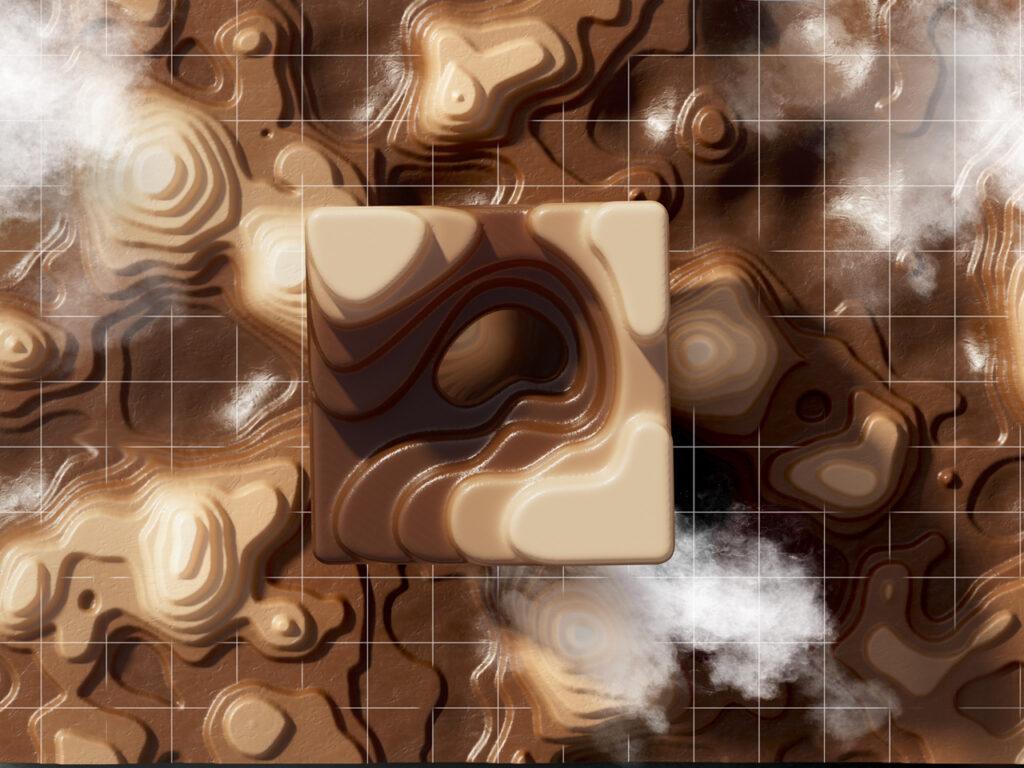

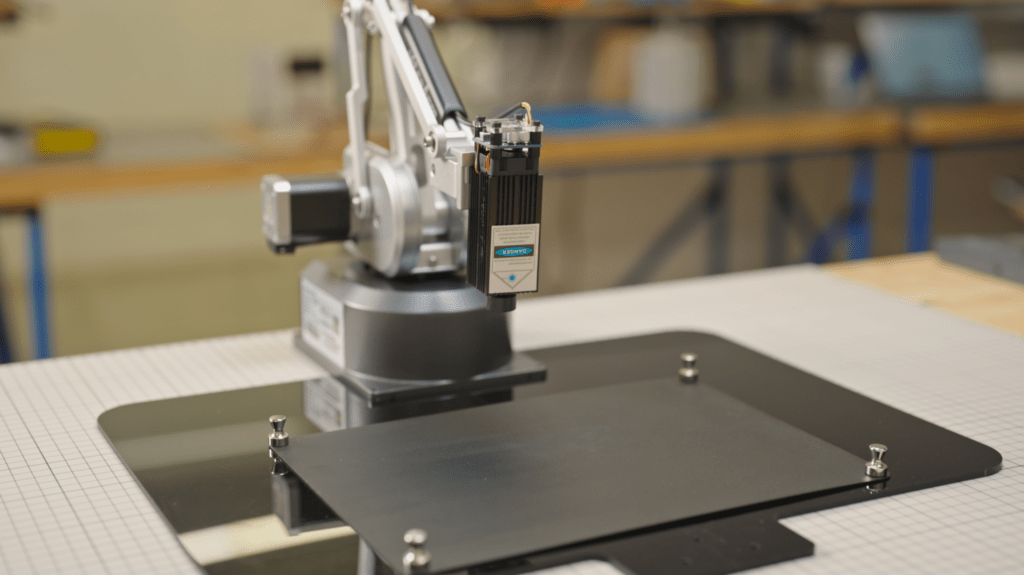

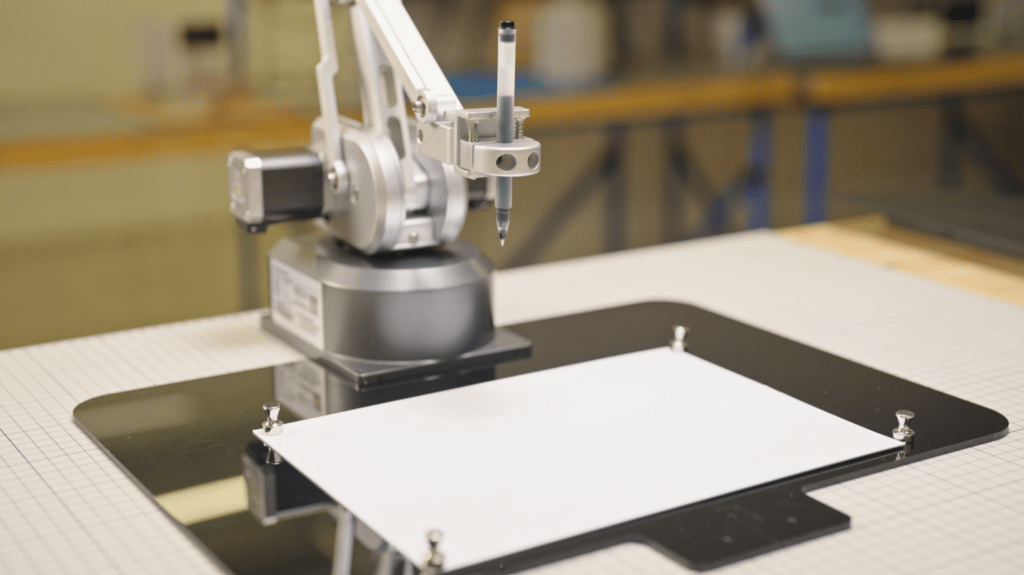

There are two kits in the DIY series: the Drawing Kit and Laser Engraving Kit. Users will enjoyonline production, nameplate and phone case DIY production, and AI drawing with the multiple accessories in the DIY kits.

To help users quickly achieve DIY production, Elephant Robotics created software called Elephant Luban. It is a platform that generates the G-Code track and provides primary cases for users. Users can select multiple functions such as precise writing and drawing, laser engravingwith, only with a few clicks. For example, users can upload the images they like to the software, Elephant Luban will automatically generate the path of images and transmit to ultraArm, then users can choose drawing or engraving with different accessories.

There is no doubt that ultraArm with different robotics kits certainly provides a great deal of help and support to the education field. These kits offer better operating environments and conditions for students, and help them get better learning in robotic programming. Elephant Robotics will continue to launch more products and projects with the concept of helping more users to enjoy the robot world.

Now ordering ultraArm in Elephant Robotics Shop can enjoy the 20% discount with the code: Ultra20