Kinder wachsen heute mit digitaler Technik auf. Tablets, Apps und vernetzte Geräte gehören zum Alltag. Aber wie funktioniert diese Technik eigentlich? 🤔

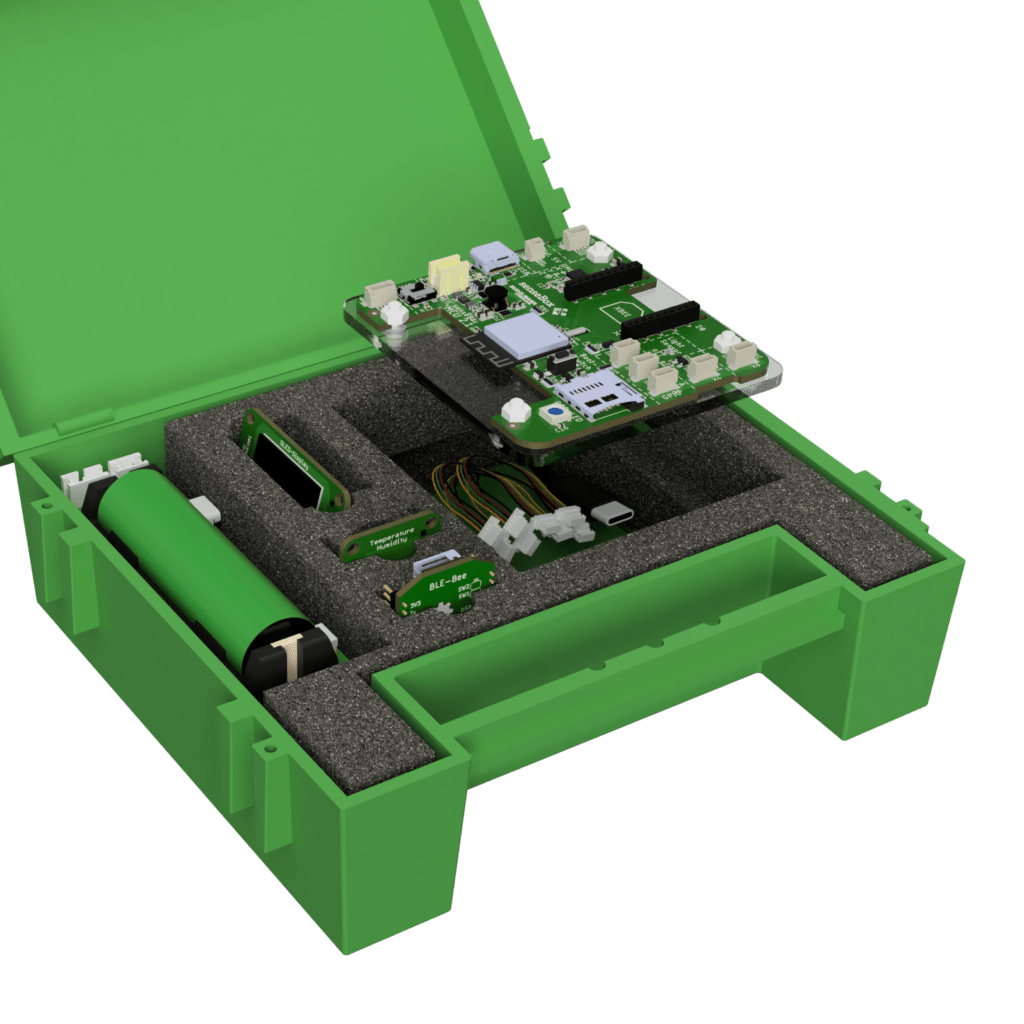

Mit der neuen senseBox:basic kommt bald ein Bausatz, der genau hier ansetzt: Digitale Bildung und informatische Grundbildung schon ab der Grundschule.

Informatische Grundbildung zum Anfassen

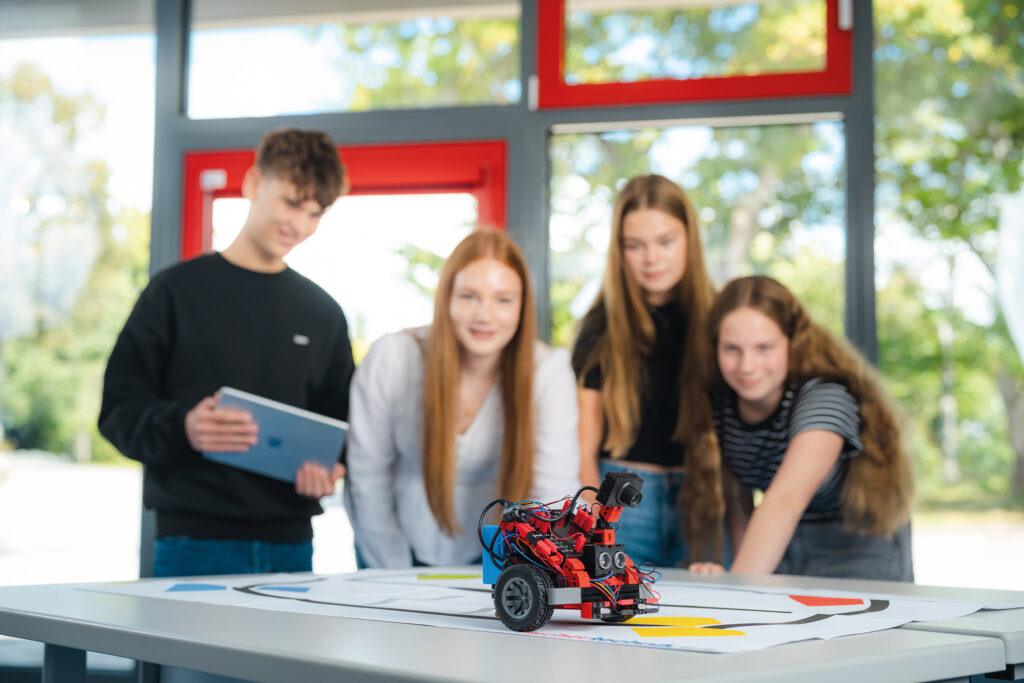

Die senseBox:basic wurde speziell für den niedrigschwelligen Einstieg in Programmierung und Sensorik entwickelt. Kinder lernen spielerisch und praxisorientiert, wie Sensoren funktionieren, wie Programme aufgebaut sind und wie Umweltdaten gemessen sowie ausgewertet werden. So wird aus dem reinen Nutzen digitaler Technologien ein fundiertes Verständnis für deren Funktionsweise.

Als vereinfachte Variante der bewährten senseBox:edu legt die senseBox:basic den Fokus auf einfache Bedienung, grundlegende Sensorprojekte und einen kostengünstigen Einstieg.

Damit eignet sie sich besonders gut für:

- Grundschulen

- erste Programmierprojekte

- AGs und Workshops

- informatische Grundbildung

Programmieren ohne Vorkenntnisse mit senseBox-Blockly

Damit der Einstieg leicht gelingt, wird mit senseBox-Blockly programmiert. Die Software steht als App kostenlos zur Verfügung. Hierbei werden Programme intuitiv aus visuellen Bausteinen zusammengesetzt – ganz ohne komplizierten Code. Kinder können zum Beispiel:

- Sensorwerte auslesen

- einfache Abläufe programmieren

- eigene kleine Experimente entwickeln

So entstehen schnell erste eigene Projekte.

Welche Sensoren sind dabei?

Die senseBox:basic ermöglicht es, Umweltphänomene selbst zu erforschen:

BME680 Umweltsensor – Dieser Sensor misst gleich mehrere Dinge:Temperatur, Luftfeuchtigkeitund Luftqualität.

Lichtsensor – Der Lichtsensor misst die Helligkeit der Umgebung. Perfekt für Projekte wie, automatische Lichtreaktionen, Experimente zu Licht und Schatten sowie Messungen der Tageshelligkeit

Beschleunigungssensor – Der Sensor erkennt Bewegungen und Erschütterungen. Damit können Kinder zum Beispiel Bewegungsprojekte programmieren, Lage im Raum bestimmen oder einfache Reaktionssysteme bauen.

Mit einem Bluetooth-Bee und einem OLED-Display können die Messwerte ganz einfach übertragen und live visualisiert werden.

Kostenloses Lehr- und Lernmaterial

Zur senseBox:basic als Hardware wird es auch kostenlose Unterrichtsmaterialien geben.

Diese stehen als Open Educational Resources (OER) zur Verfügung und enthalten:

- Projekte zum Nachbauen

- Unterrichtsideen

- Materialien für den Einstieg in Programmierung

Die Sammlung wird kontinuierlich erweitert.

Online-Meetup zur senseBox:basic

Wer mehr über die neue senseBox erfahren möchte ist herzlich zum kostenlosen Online-Meetup eingeladen. Dort stellt das Team von re:edu die senseBox:basic vor und beantwortet Fragen. Das senseBox-Meetup findet bis zum Sommer jeden zweiten Dienstag im Monat von 15–16 Uhr via Zoom statt. Der erste Termin ist am 14. April.

Weitere Informationen zur senseBox:basic:https://sensebox.de/de/products-basic

Fazit – Digitale Bildung zum Anfassen

Mit der senseBox:basic wird der Einstieg in Programmierung, Sensorik und digitale Technologien bereits ab dem Grundschulalter möglich – einfach, praxisnah und mit viel Raum zum Experimentieren. Damit leistet sie einen wichtigen Beitrag zur frühzeitigen Förderung digitaler Kompetenzen. Nachdem das Produkt auf der Didacta 2026 erstmals im Rahmen einer Preview präsentiert wurde, ist es nun bereits im Shop erhältlich und die Auslieferung erfolgt in Kürze: https://sensebox.kaufen/products/sensebox-basic