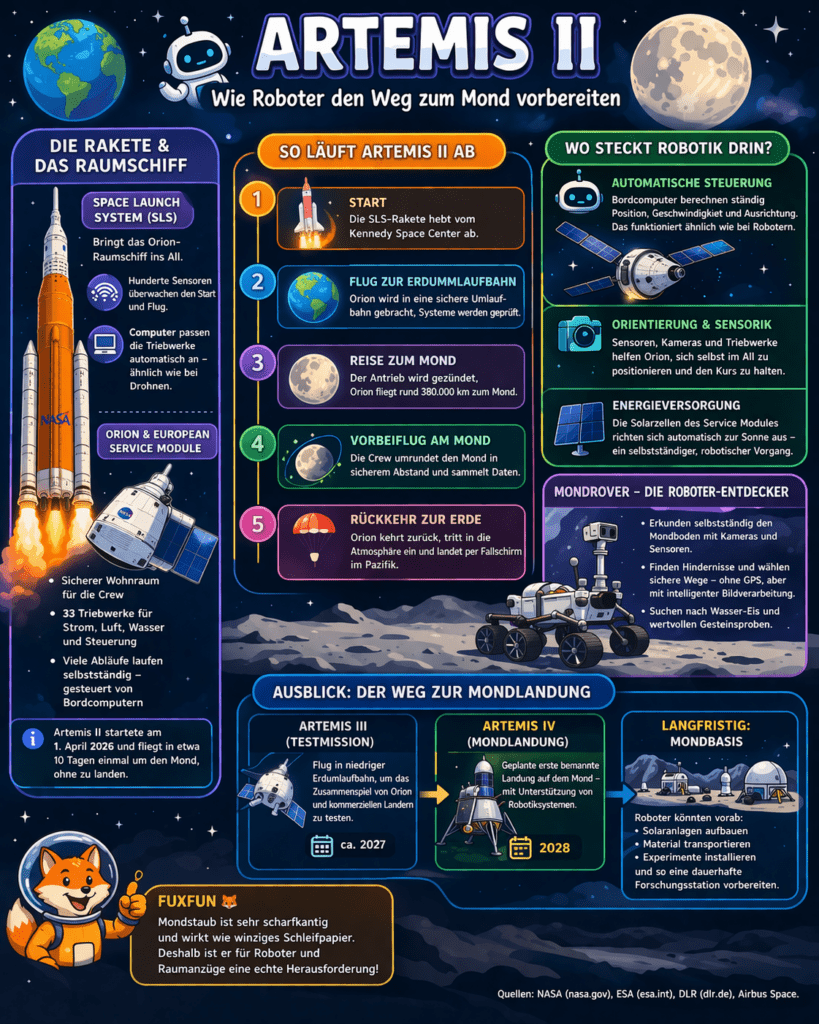

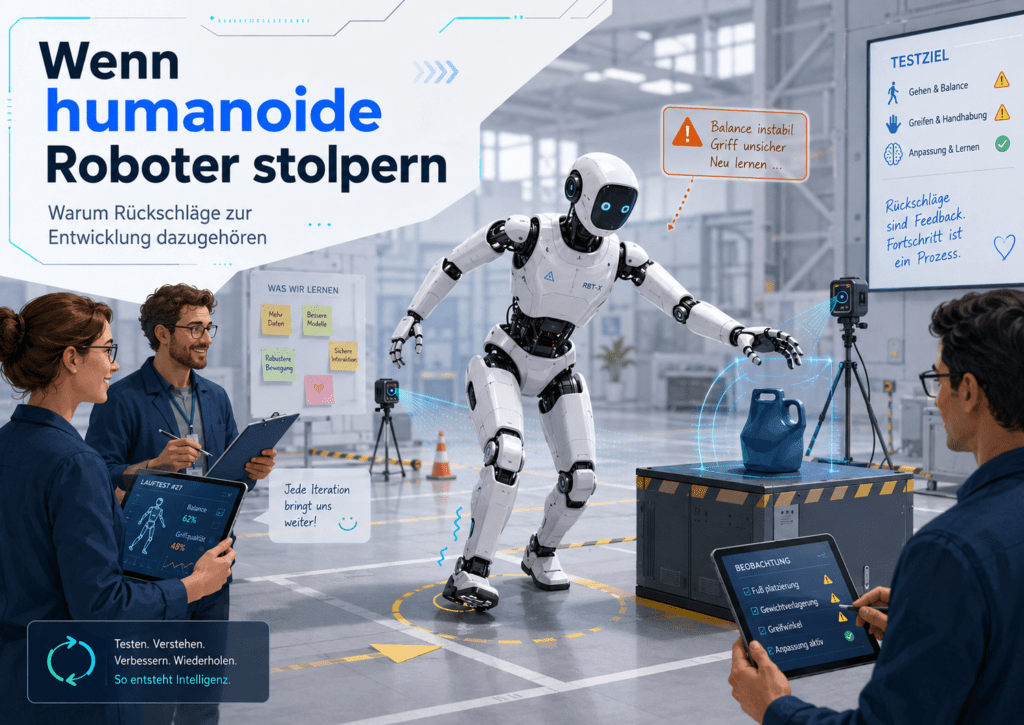

Humanoide Roboter sehen oft aus wie Zukunft zum Anfassen: zwei Arme, zwei Beine, Kameras als „Augen“ und manchmal sogar eine Stimme, die mit dir spricht. In Videos tragen sie Kisten, öffnen Türen oder winken freundlich in die Kamera.

Aber was passiert, wenn die Kamera aus ist?

Dann wird es besonders spannend. Denn Rückschläge gehören zur Robotik genauso dazu wie Erfolge. Nur wird über sie viel seltener gesprochen. Dabei lernen Entwicklerinnen, Forscher und Unternehmen gerade aus diesen schwierigen Momenten am meisten.

1. Vorführungen sind nicht dasselbe wie Alltag

Viele Menschen kennen humanoide Roboter aus kurzen Videos. Da läuft alles glatt: Der Roboter greift, läuft, balanciert und wirkt fast wie ein künstlicher Kollege.

Praxisberichte zeigen aber: Echtes Ausprobieren ist viel komplizierter. Ein Roboter muss vorbereitet, überwacht und oft an die Umgebung angepasst werden. Was in einem Testlabor klappt, funktioniert nicht automatisch in einer Werkhalle, einem Pflegeheim oder einem Büro. Das ist wie bei einem Zaubertrick: Von vorne sieht alles leicht aus. Hinter der Bühne steckt sehr viel Übung, Technik und manchmal auch ein missglückter Versuch.

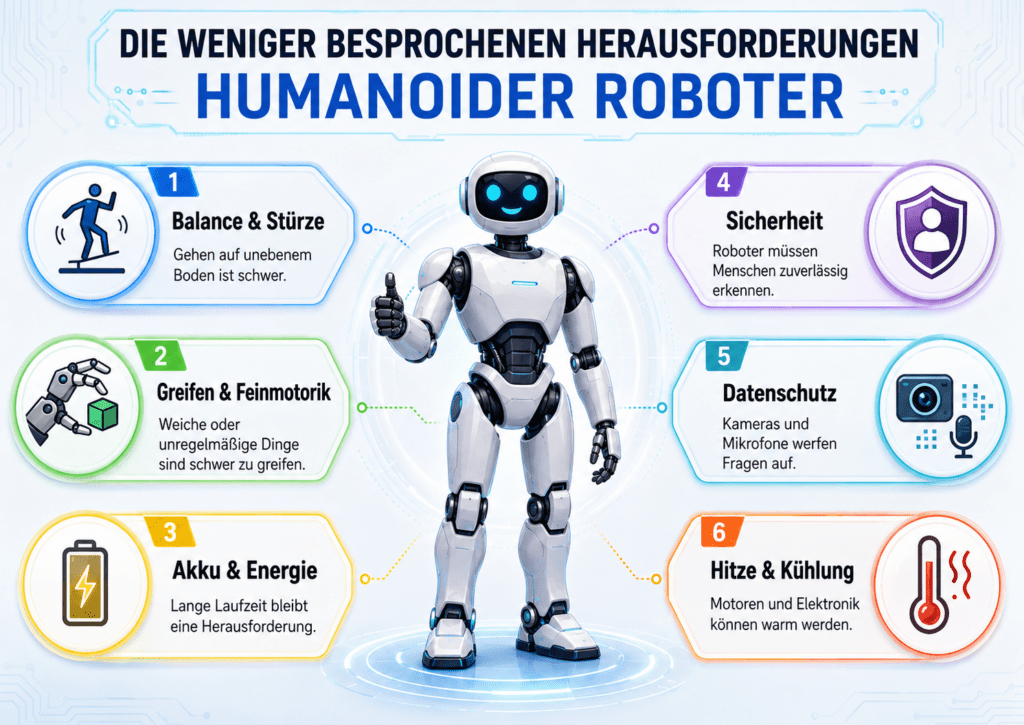

2. Laufen ist für Roboter extrem schwer

Für dich ist Gehen meistens selbstverständlich. Dein Körper merkt ganz automatisch, ob der Boden schief ist, ob du stolperst oder ob du dein Gewicht verlagern musst. Ein humanoider Roboter muss das berechnen. Er braucht Sensoren, Motoren, Steuerungssoftware und schnelle Entscheidungen. Besonders schwierig wird es, wenn der Boden uneben ist, Menschen vorbeilaufen oder der Roboter etwas tragen soll.

Wenn ein kleiner Spielzeugroboter umfällt, ist das lustig. Wenn ein großer humanoider Roboter kippt, kann es gefährlich werden. Deshalb testen viele Firmen solche Roboter zuerst in streng kontrollierten Bereichen.

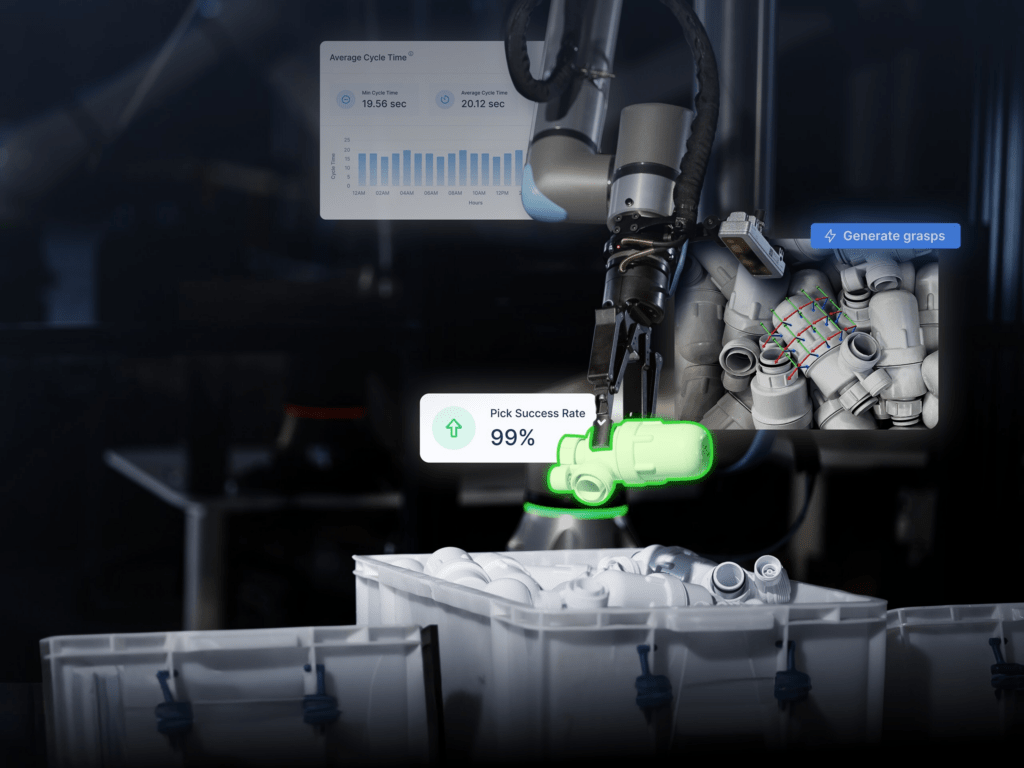

3. Greifen ist nicht einfach nur „Hand zu“

Eine Kiste greifen klingt leicht. Aber was ist mit einer weichen Tasche, einem Kabel, einem Werkzeug oder einer zerknitterten Verpackung? Für Roboterhände sind solche Dinge schwierig. Sie müssen erkennen, wie fest sie drücken dürfen, wo sie anfassen sollen und ob der Gegenstand verrutscht. Menschen spüren das mit Haut, Muskeln und Erfahrung. Roboter brauchen dafür Sensoren und gute Programme.

Darum ist Feinmotorik eine der großen Baustellen. Ein humanoider Roboter kann manchmal beeindruckend aussehen und trotzdem an einer scheinbar einfachen Alltagssache scheitern.

4. Sicherheit heißt mehr als ein Not-Aus-Knopf

Humanoide Roboter sollen oft dort arbeiten, wo auch Menschen sind. Das macht sie spannend, aber auch kompliziert. Sie müssen Menschen zuverlässig erkennen, Abstand halten, nicht zu schnell reagieren und bei Unsicherheit stoppen. Außerdem stellt sich die Frage: Was nehmen Kameras und Mikrofone auf? Werden Daten gespeichert? Wer darf sie ansehen?

Gerade in Unternehmen oder Pflegeeinrichtungen sind solche Fragen wichtig. Ein Roboter ist nicht nur eine Maschine mit Armen und Beinen. Er ist auch ein Gerät mit Sensoren, Daten und Verantwortung.

5. Pflege und Alltag brauchen Akzeptanz

Im Pflegebereich wurden humanoide Roboter bereits in Pilotprojekten getestet. Sie können Menschen zum Bewegen, Denken oder Mitmachen motivieren. Das ist wertvoll. Aber auch hier gibt es Grenzen. Roboter ersetzen keine Pflegekräfte. Sie brauchen Menschen, die sie vorbereiten, begleiten und sinnvoll einsetzen. Außerdem müssen Bewohnerinnen und Bewohner den Roboter akzeptieren. Manche finden ihn spannend, andere vielleicht seltsam oder störend.

Das zeigt: Technik allein reicht nicht. Ein Roboter muss auch in den Alltag der Menschen passen.

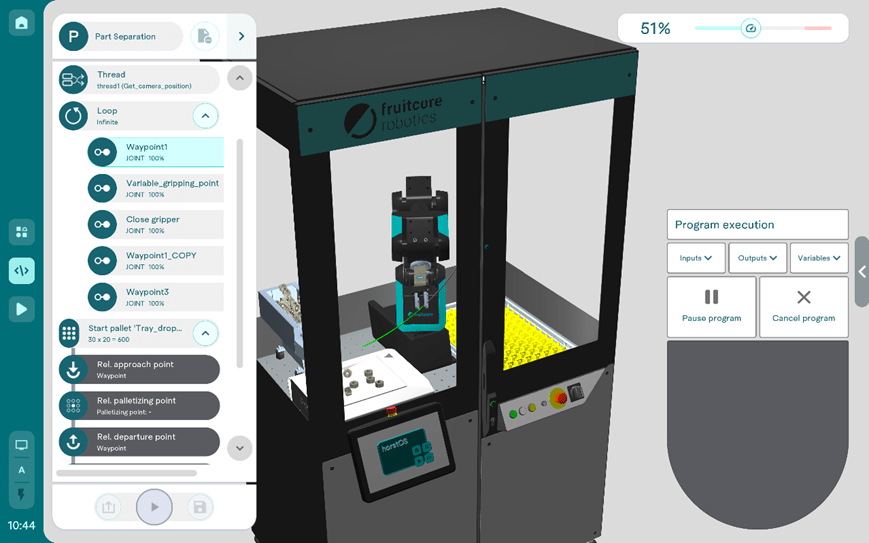

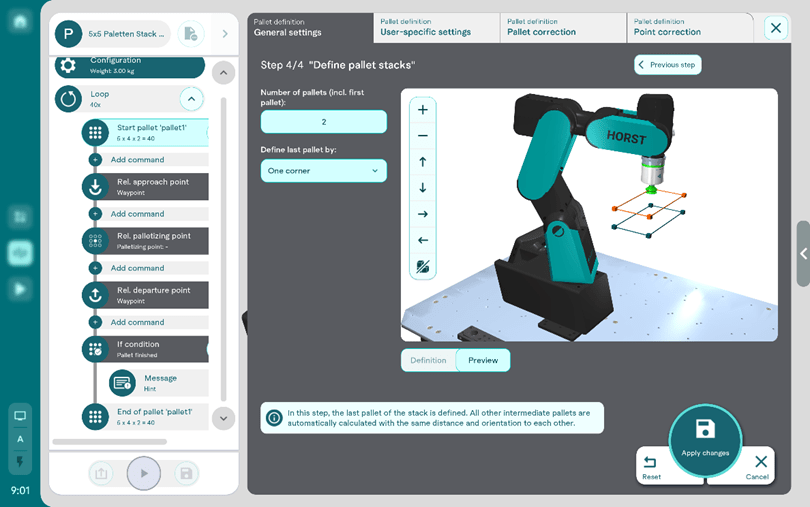

6. Unternehmen testen vorsichtig

Auch Firmen probieren humanoide Roboter aus, zum Beispiel in Industrie, Logistik oder Entwicklung. Dort geht es oft um Aufgaben wie Tragen, Sortieren oder einfache Handgriffe.

Doch bevor ein humanoider Roboter wirklich nützlich ist, muss vieles stimmen: Er muss zuverlässig arbeiten, sicher sein, lange genug durchhalten und sich wirtschaftlich lohnen. Wenn ein klassischer Roboterarm oder ein Förderband dieselbe Aufgabe günstiger und zuverlässiger erledigt, ist der humanoide Roboter nicht automatisch die beste Wahl. Das klingt ernüchternd, ist aber wichtig. Gute Technik wird nicht daran gemessen, wie cool sie aussieht, sondern ob sie ein echtes Problem löst.

7. Akku, Wärme und Technikstress

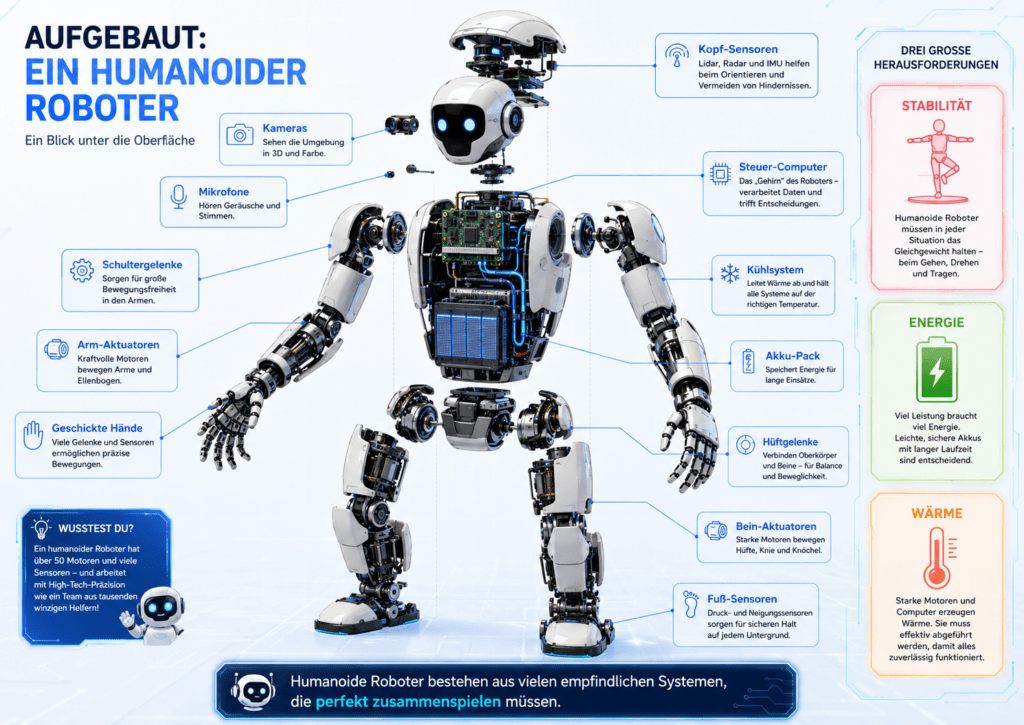

Humanoide Roboter brauchen viel Energie. Viele Motoren bewegen Arme, Beine, Hände und Kopf. Gleichzeitig arbeiten Computer, Kameras und Sensoren. Das kostet Strom und erzeugt Wärme.

Wärme ist für Roboter ein ernstes Thema. Elektronik und Motoren müssen gekühlt werden, damit sie zuverlässig funktionieren. Forschungsbeispiele wie schwitzende Wärmepuppen zeigen außerdem, wie komplex Temperatur und Körpertechnik bei menschenähnlichen Maschinen sein können. Ein Roboter hat also keinen Muskelkater. Aber er kann technische Probleme bekommen: leerer Akku, warme Motoren, fehlerhafte Sensoren oder Software, die noch lernen muss.

Fazit

Humanoide Roboter sind faszinierend. Aber sie sind noch keine perfekten Alltagshelfer. Sie kämpfen mit Balance, Greifen, Sicherheit, Datenschutz, Energie, Wärme und der Frage, wo sie wirklich sinnvoll eingesetzt werden können.

Das ist kein Scheitern. Es ist Entwicklung.

Jeder Rückschlag zeigt den Ingenieurinnen und Forschern: Hier müssen wir besser werden. Genau so entsteht Fortschritt – nicht nur durch glänzende Erfolgsvideos, sondern auch durch Tests, Fehler und ehrliches Lernen.

FuxFun

Wusstest du, dass eine zerknitterte Chipstüte für einen Roboter schwieriger sein kann als eine schwere Metallbox? Die Box ist stabil und berechenbar. Die Tüte knistert, rutscht, verformt sich und sieht jedes Mal ein bisschen anders aus.

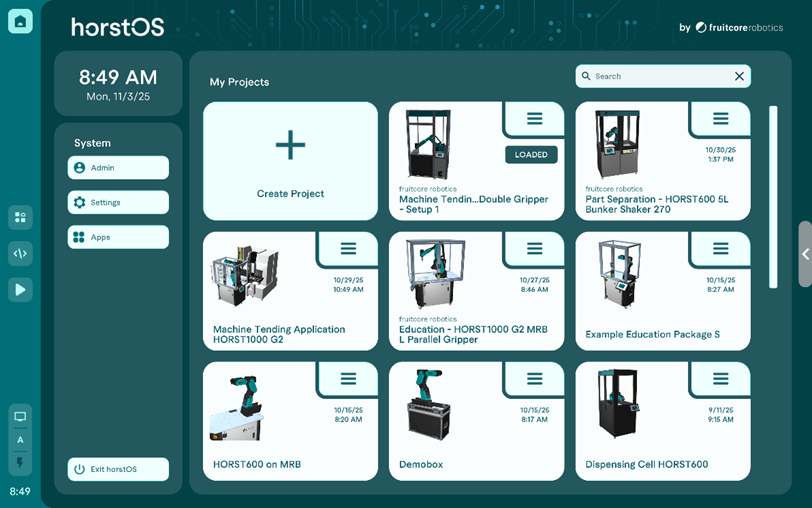

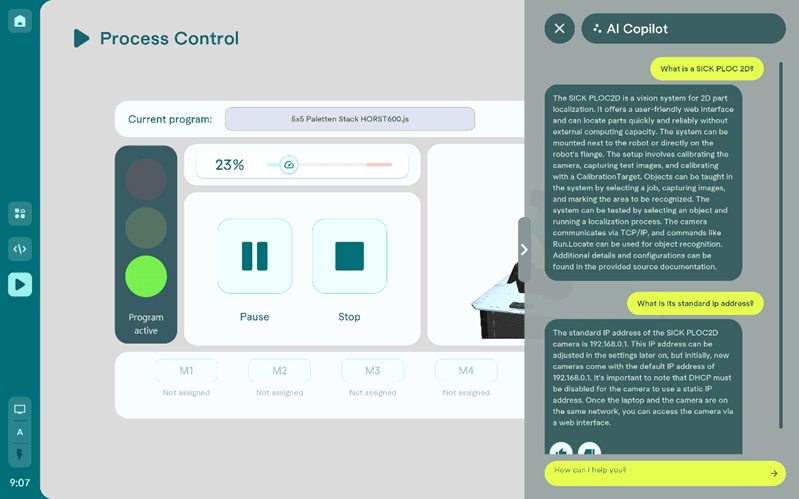

Für Profis

Wer tiefer einsteigen möchte, kann nach Praxisberichten und Einordnungen von c’t 3003/Heise, Exxeta, Fraunhofer IPA, ROBUST/vdek NRW sowie Industrieeinschätzungen von Springer Professional, Elektronikpraxis und Industriemagazin suchen.

Quellenverweis

Genutzte Quellenauswahl: Heise/c’t 3003 „Humanoide Roboter ausprobiert“, Exxeta „Warum humanoide Roboter keine Zukunftsvision mehr sind“, ROBUST/vdek NRW zum Einsatz humanoider Roboter im Pflegekontext, Fraunhofer IPA zu Status quo, Potenzialen und Forschungsfeldern humanoider Roboter, Springer Professional und Elektronikpraxis zur industriellen Einordnung sowie Welt/scinexx zu schwitzenden Robotern und Wärmemanagement.

Buchempfehlung

Noch mehr Robotik und KI für neugierige Köpfe findest du im Buch „Roboter & KI“ aus der SchlauFUX-Reihe vom Kosmos Verlag:

https://www.kosmos.de/de/kosmos-schlaufux-roboter-und-ki_1182437_9783440182437