Aktionswochenende und Ausstellung mit Lena Reifenhäuser und Sebastian Trella im Deutschen Museum Bonn

Was macht Kunst aus? Wie kann man KI im Bereich der Kunst für sich nutzen? Und wer ist dann der Urheber des Werks? Diese Frage steht im Mittelpunkt eines besonderen Wochenendes im Deutschen Museum Bonn mit Künstlerin Lena Reifenhäuser und Robotik-Spezialist Sebastian Trella.

Künstliche Intelligenz gewinnt in fast jedem Beruf immer mehr an Bedeutung. Insbesondere in kreativen Berufsfeldern zeichnet sich ab, dass es nur eine Frage der Zeit ist, dass die Nutzung von KI-Tools unumgänglich wird. Wo führt die Reise hin? Ist mit KI bald jeder Mensch ein Künstler? Und was bedeutet dies für unser Verständnis von Kunst?

Künstlerin Lena Reifenhäuser und Robotik-Enthusiast Sebastian Trella zeigen ein Wochenende lang in einem gemeinsamen Ausstellungsprojekt im Deutschen Museum Bonn, wie man KI-Anwendungen im Bereich der Kunst für sich nutzen kann und welche Möglichkeiten es dafür geben kann. Sie veranschaulichen, wie ausgehend vom Ursprungswerk eines Künstlers KI-generierte Kunst entsteht. Welche Schritte sind dafür nötig? Und wer ist am Ende eigentlich der Künstler, der Urheber des Werks, der die kreative Leistung erbracht hat? Handelt es sich um eine neue Art künstlerischer Zusammenarbeit?

»Eine Künstliche Intelligenz, also eine Maschine, arbeitet in Perfektion und wesentlich schneller als ein Mensch«, so Lena Reifenhäuser. »Aber sind es nicht genau unsere kleinen menschlichen ›Fehler‹ oder Abweichungen, die etwas überhaupt zu Kunst machen?«

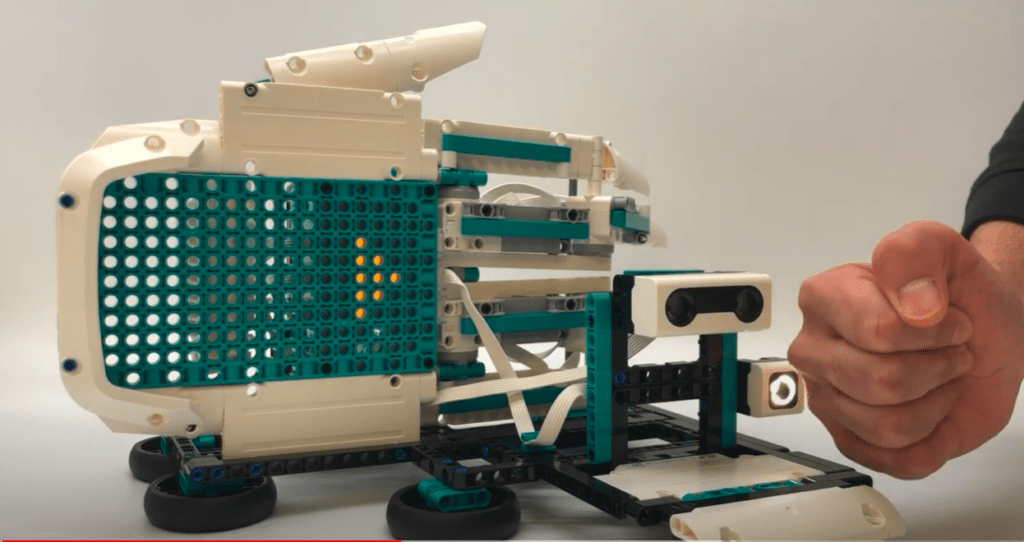

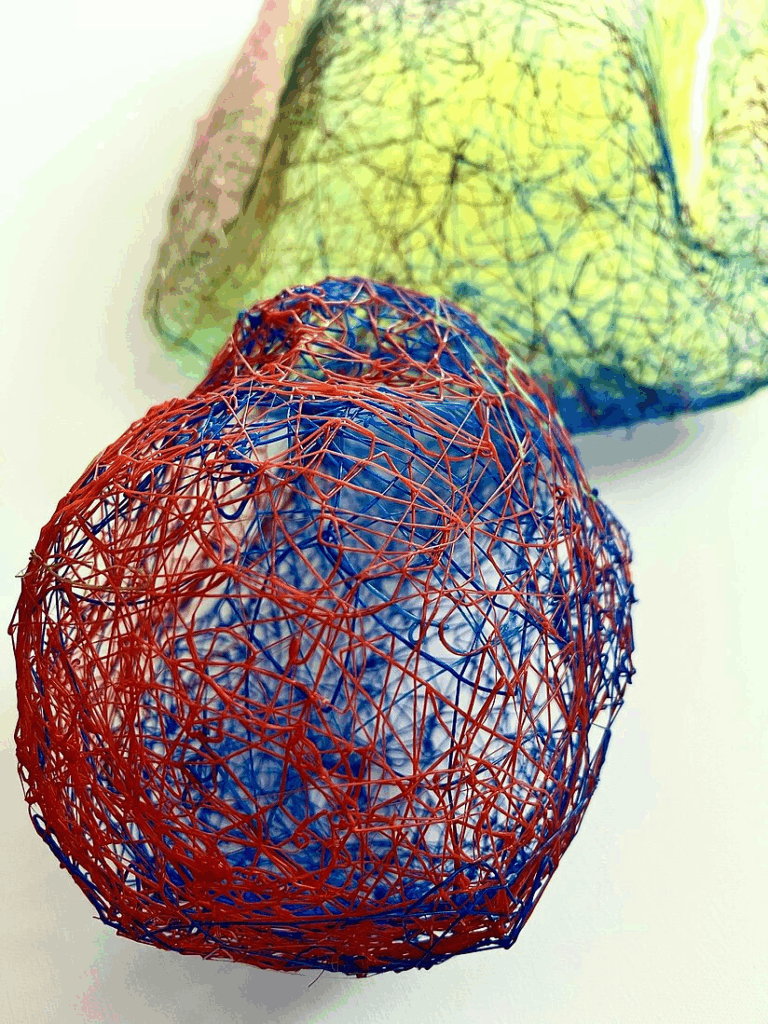

Die Ausstellung regt Fragen wie diese an, indem sie Werke der Künstlerin auf überraschende Weise präsentiert, multimedial neu interpretiert und dadurch gleichzeitig weiterentwickelt – sowohl mit als auch ohne KI. Sebastian Trellas Expertise im Bereich der Robotik und KI erweckt Zeichnungen und Malereien beispielsweise als Videoinstallationen zum Leben und eine KI erweitert bestehende Werke der Künstlerin völlig frei.

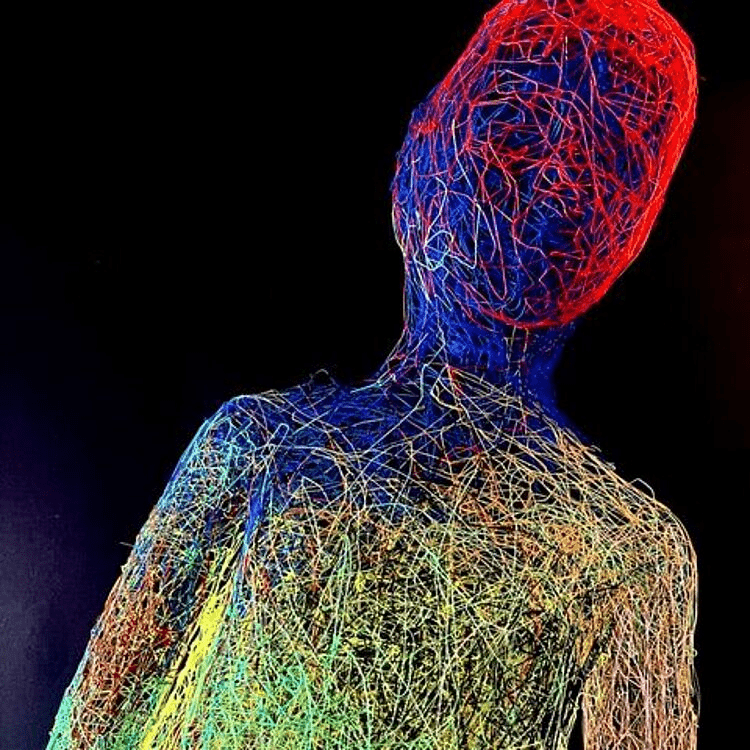

Im Zentrum dabei stets präsent: Die von Lena Reifenhäuser eigens für die Aktion mit einem 3D-Druckstift gefertigte Skulptur MANUEL(L) regt als manuell gefertigte Gegenüberstellung zur KI-Kunst zur Diskussion an.

Als Höhepunkt der Ausstellung wird ein völlig neues Werk, das von einer ausschließlich mit künstlerischen Arbeiten von Lena Reifenhäuser trainierten KI erstellt wurde, enthüllt und im Deutschen Museum Bonn an diesem Wochenende zum ersten Mal zu sehen sein.

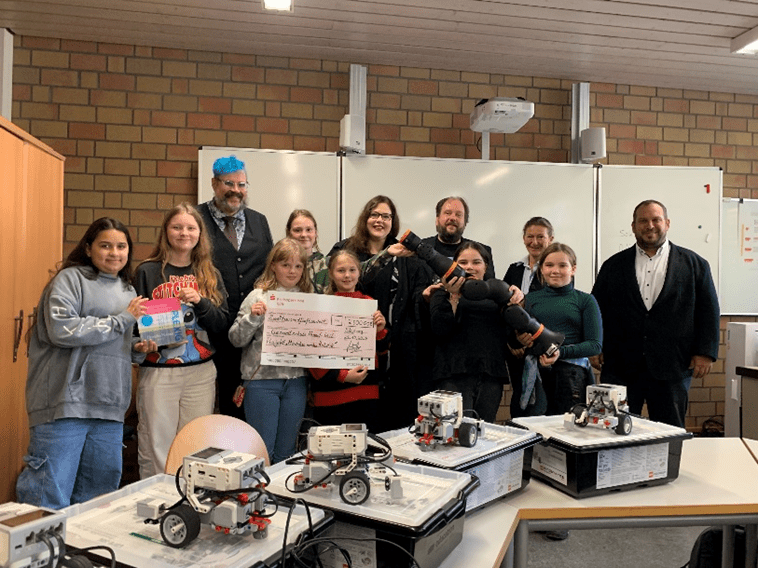

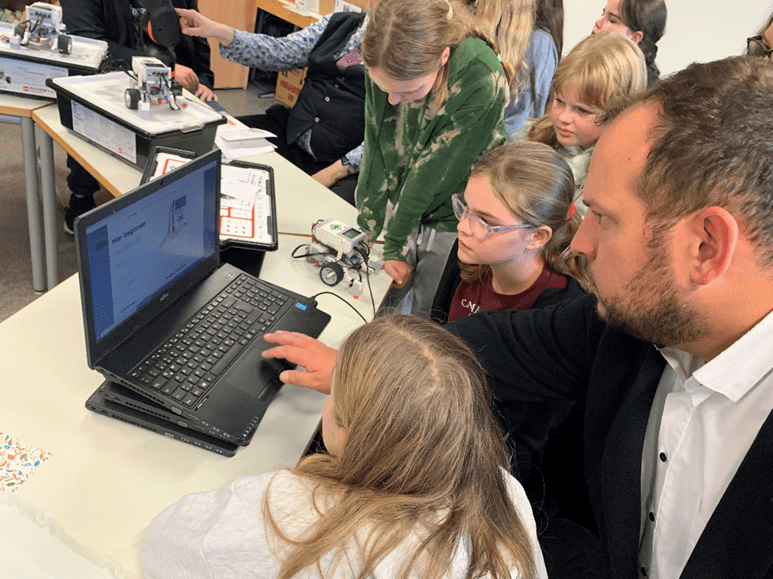

An interaktiven Stationen können die Museumsgäste nicht zuletzt ihre eigene Kreativität ausleben: Eine 3D-Druckstift-Station bietet beispielsweise Groß und Klein die Möglichkeit, eigene Skulpturen zu erschaffen. Zudem kann ein Roboter in künstlerischer Aktion an beiden Tagen live erlebt werden.

Über die Künstler

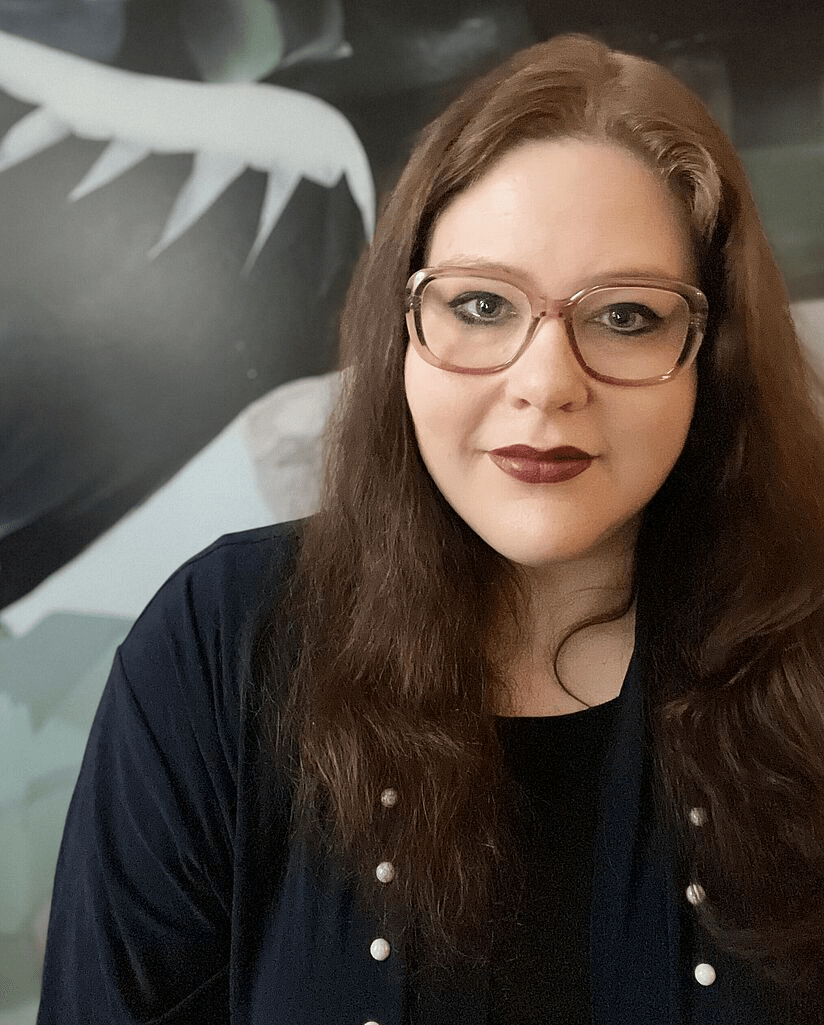

Lena Reifenhäuser wurde 1986 in Troisdorf geboren und lebt in Bonn. 2018 hat sie den Studiengang Bildende Kunst mit der Fachrichtung Malerei an der Alanus Hochschule für Kunst und Gesellschaft in Alfter bei Bonn, abgeschlossen. Seitdem arbeitet sie als freischaffende Künstlerin. Zahlreiche Projekte und Ausstellungen im In- und Ausland, darunter Krakau, Georgien und China, runden ihre künstlerische Tätigkeit ab. Seit 2019 hat Lena Reifenhäuser ein Atelier im Kunsthaus Troisdorf.

Links: lenareifenhaeuser.de; www.instagram.com/lena_reifenhaeuser

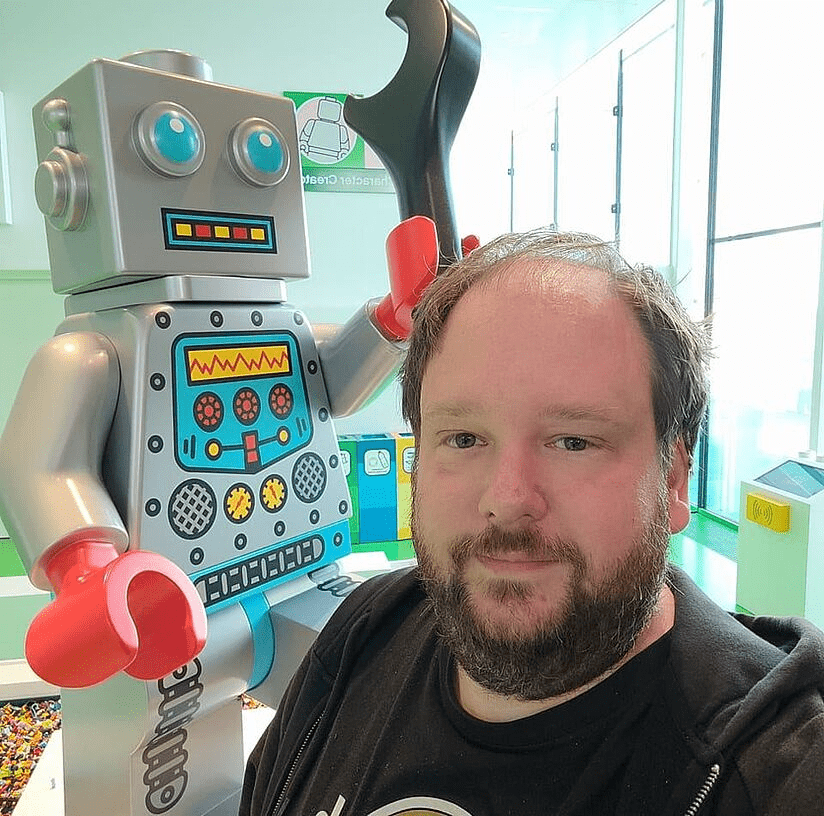

Sebastian Trella wurde 1986 geboren und lebt in Troisdorf. Von 2007-2014 war er im Bereich Educational Robotics am Fraunhofer IAIS tätig und sammelt seitdem in seiner Freizeit Roboter und testet neue Robotik-Produkte für diverse Unternehmen. Er arbeitet hauptberuflich als Informatiker und betrachtet künstliche Intelligenz als einen faszinierenden Weg, Roboter zum Leben zu erwecken. Seit 2010 teilt er sein Wissen über Roboter und KI auf seiner Webseite Robots-Blog.com.

Lena Reifenhäuser und Sebastian Trella unterstützen das Deutsche Museum Bonn als Mitglieder von WISSENschaf(f)t SPASS – Förderverein für Bildung und Innovation im Rheinland e.V.