Stell dir vor, du liegst in einem riesigen Scanner, der dein Gehirn fotografiert – und gleichzeitig hilft ein Roboter einem Arzt dabei, eine Operation durchzuführen. Was nach Science-Fiction klingt, wird jetzt Realität. Forschende haben ein vollständig robotisches System entwickelt, das direkt in einem MRT-Scanner arbeiten kann. Diese neue Technologie könnte Operationen am Gehirn in Zukunft deutlich präziser und sicherer machen.

Warum ein MRT bei Operationen so hilfreich ist

Ein MRT (Magnetresonanztomograph) ist eine Maschine, die extrem detaillierte Bilder vom Inneren des Körpers erzeugt. Besonders beim Gehirn sind diese Bilder für Ärzte unglaublich wertvoll. Man kann sich das MRT wie eine Art Superkamera für den Körper vorstellen. Sie zeigt zum Beispiel, wo sich ein Tumor befindet, wie Blutgefäße verlaufen oder welche Bereiche des Gehirns für Sprache und Bewegung verantwortlich sind.

Während einer Operation wäre es natürlich ideal, solche Bilder ständig sehen zu können. Genau hier liegt aber das Problem: Ein MRT arbeitet mit sehr starken Magnetfeldern. Viele chirurgische Instrumente oder Roboter enthalten Metall und können deshalb im Scanner nicht eingesetzt werden. Sie würden vom Magnetfeld gestört oder sogar gefährlich angezogen werden.

________________________________________

Ein Roboter, der im Magnetfeld arbeiten kann

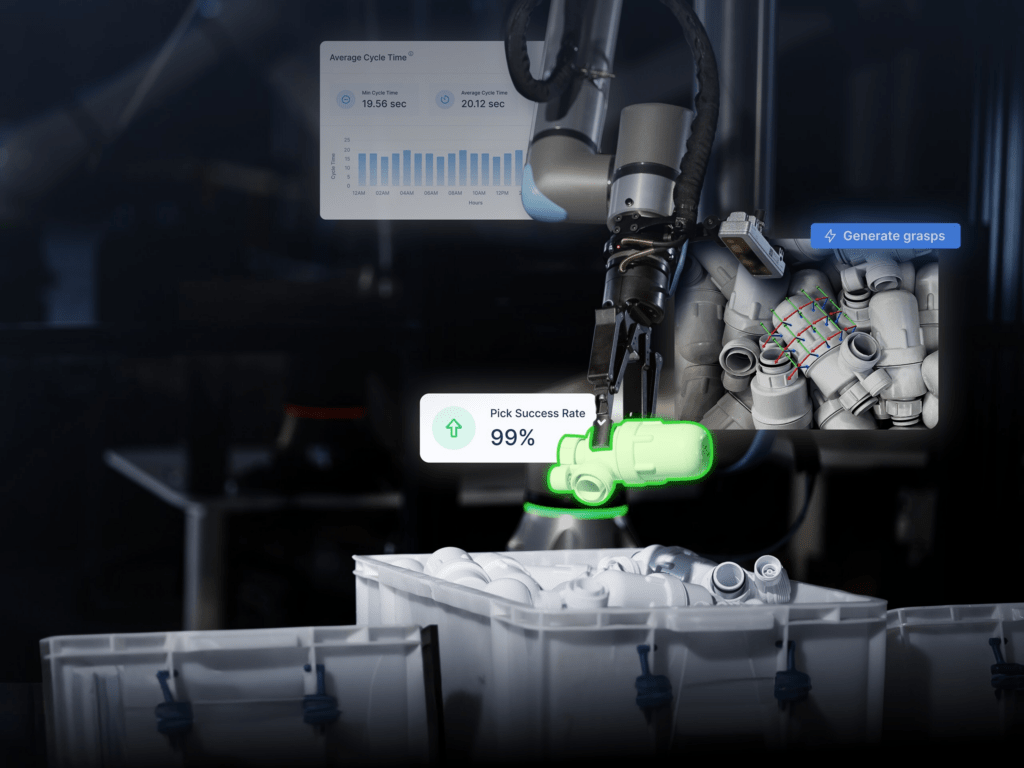

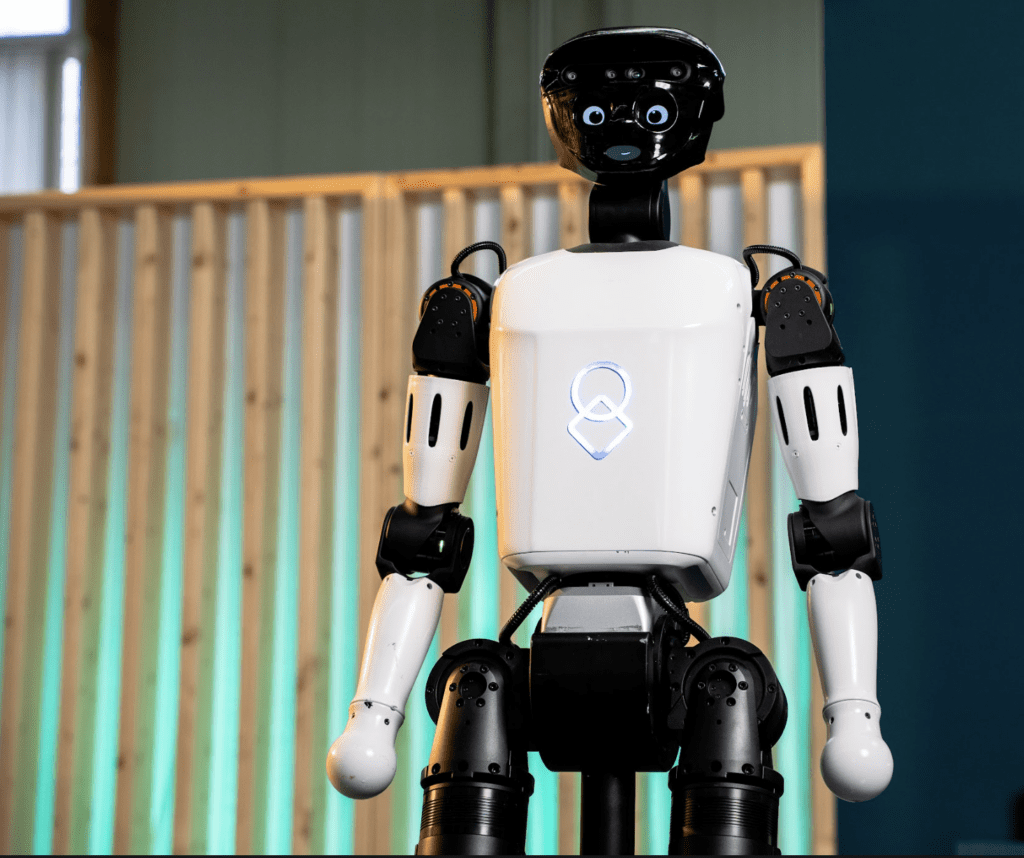

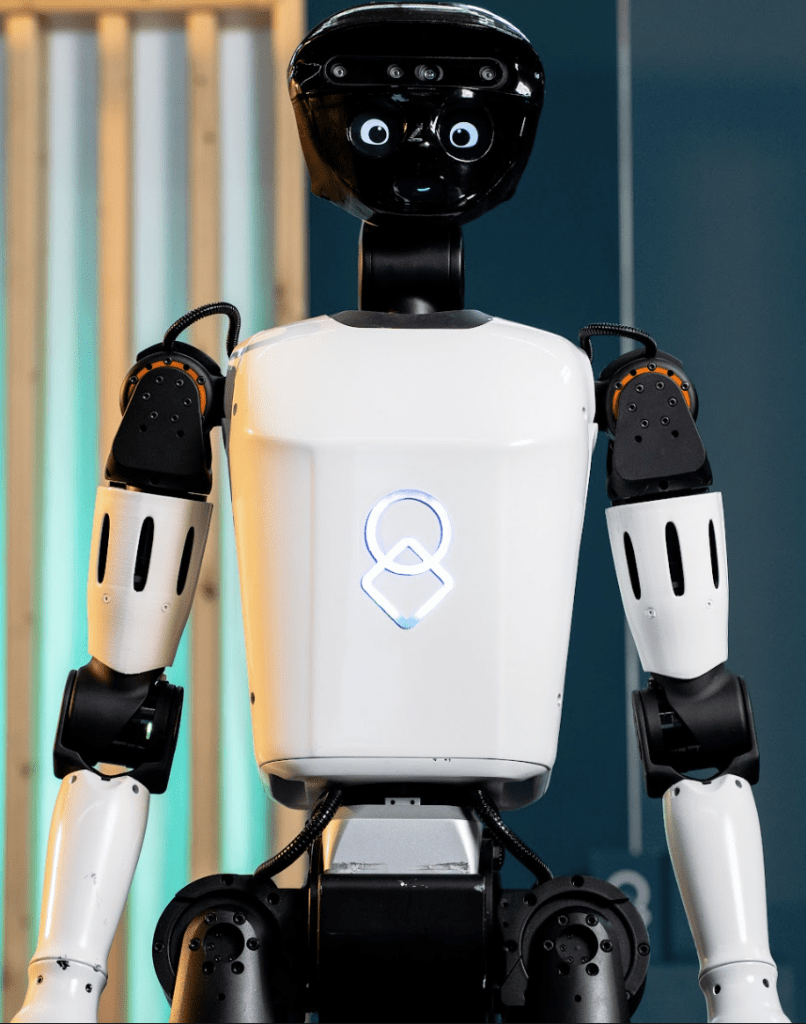

Genau deshalb ist die neue Entwicklung so spannend. Ein Forschungsteam hat einen Operationsroboter gebaut, der speziell dafür entwickelt wurde, im starken Magnetfeld eines MRT zu funktionieren.

Damit das möglich ist, mussten die Ingenieure viele technische Probleme lösen. Der Roboter besteht aus besonderen Materialien, die nicht magnetisch sind. Außerdem nutzt er spezielle Antriebstechniken, die im Scanner keine Störungen verursachen.

Der große Vorteil dieser Technik ist, dass das MRT während der Operation ständig neue Bilder liefern kann. Der Chirurg sieht also in Echtzeit, wo sich seine Instrumente befinden und wie nah sie an empfindlichen Hirnregionen sind. Dadurch kann er viel genauer arbeiten.

________________________________________

Millimeterarbeit im Gehirn

Operationen am Gehirn gehören zu den schwierigsten Eingriffen in der Medizin. Oft entscheiden schon wenige Millimeter darüber, ob wichtige Funktionen erhalten bleiben. Ein minimaler Fehler könnte zum Beispiel Bereiche betreffen, die für Sprache, Bewegung oder Gedächtnis verantwortlich sind.

Hier kann ein Roboter eine enorme Hilfe sein. Seine Bewegungen sind extrem ruhig und präzise. Während ein Mensch durch kleine Muskelbewegungen immer ein wenig zittert, kann der Roboter Instrumente mit sehr hoher Genauigkeit führen. So lassen sich beispielsweise feine Nadeln exakt platzieren, Gewebeproben entnehmen oder Medikamente direkt an eine bestimmte Stelle im Gehirn bringen.

Wichtig ist dabei: Der Roboter ersetzt den Arzt nicht. Der Chirurg steuert das System und entscheidet jeden einzelnen Schritt. Der Roboter ist also eher wie eine hochpräzise Werkzeugverlängerung der menschlichen Hand.

________________________________________

Neue Chancen für die Medizin

Die Kombination aus Robotik und MRT-Bildgebung eröffnet ganz neue Möglichkeiten. Besonders bei Krankheiten wie Hirntumoren, Parkinson oder Epilepsie könnte diese Technologie helfen. Bei einigen Therapien müssen Elektroden oder Medikamente an ganz bestimmten Stellen im Gehirn platziert werden. Mit Hilfe eines Roboters und gleichzeitig laufenden MRT-Bildern könnte das deutlich genauer gelingen als bisher.

Auch zukünftige Entwicklungen sind spannend. Forschende arbeiten bereits daran, solche Systeme mit künstlicher Intelligenz zu verbinden. Dann könnten Computerprogramme während der Operation zusätzliche Informationen liefern oder den Ärzten bei schwierigen Entscheidungen helfen.

________________________________________

Fazit

Der neue MRT-kompatible Operationsroboter zeigt eindrucksvoll, wie Robotik die Medizin verändert. Durch die Kombination aus hochauflösender Bildgebung und präziser Technik können Ärzte während einer Operation genau sehen, was im Gehirn passiert. Das macht Eingriffe sicherer und eröffnet völlig neue Behandlungsmöglichkeiten.

Vielleicht werden in Zukunft in vielen Operationssälen Ärzte und Roboter Seite an Seite arbeiten, um Menschen noch besser zu helfen.

________________________________________

FuxFun 🦊

Wusstest du, dass …

die Magnete in einem MRT etwa 10.000-mal stärker als das Magnetfeld der Erde sein können? Deshalb müssen sogar einfache Gegenstände wie Scheren oder Sauerstoffflaschen speziell für MRT-Räume geprüft sein.

________________________________________

Für Profis

Wer tiefer in das Thema einsteigen möchte, kann sich mit folgenden Bereichen beschäftigen:

• MRT-kompatible Robotik

• bildgeführte Neurochirurgie

• minimalinvasive robotische Operationen

________________________________________

Quellen

Radiology Business

„Experts develop first-of-its-kind fully robotic MRI-compatible system for neurosurgery“