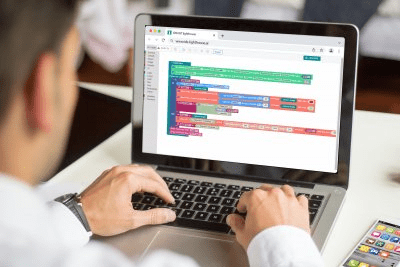

RobotCreator DX offers intuitive software interfaces to make customization and interaction with the robot unintimidating for beginners and advanced users alike.

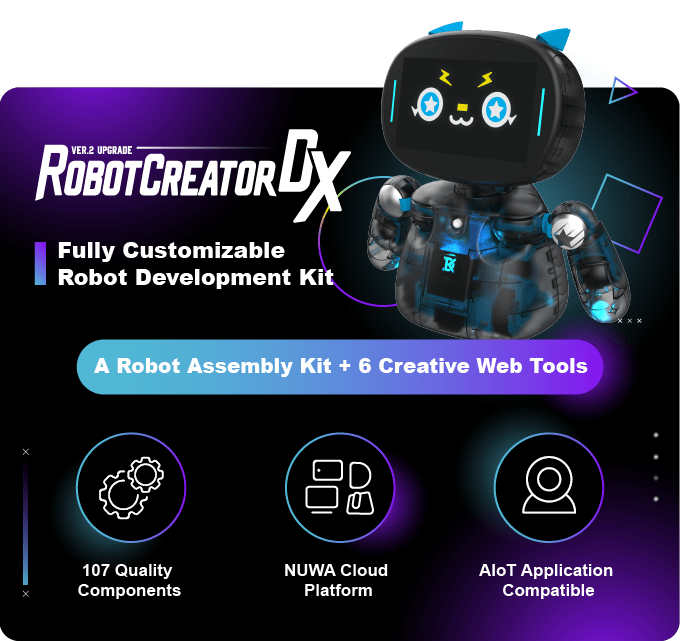

Taipei, Taiwan, 07 July, 2022 – NUWA announced on Kickstarter, the all-new RobotCreator DX, a highly customizable AI robot companion designed for users of all levels of skills.

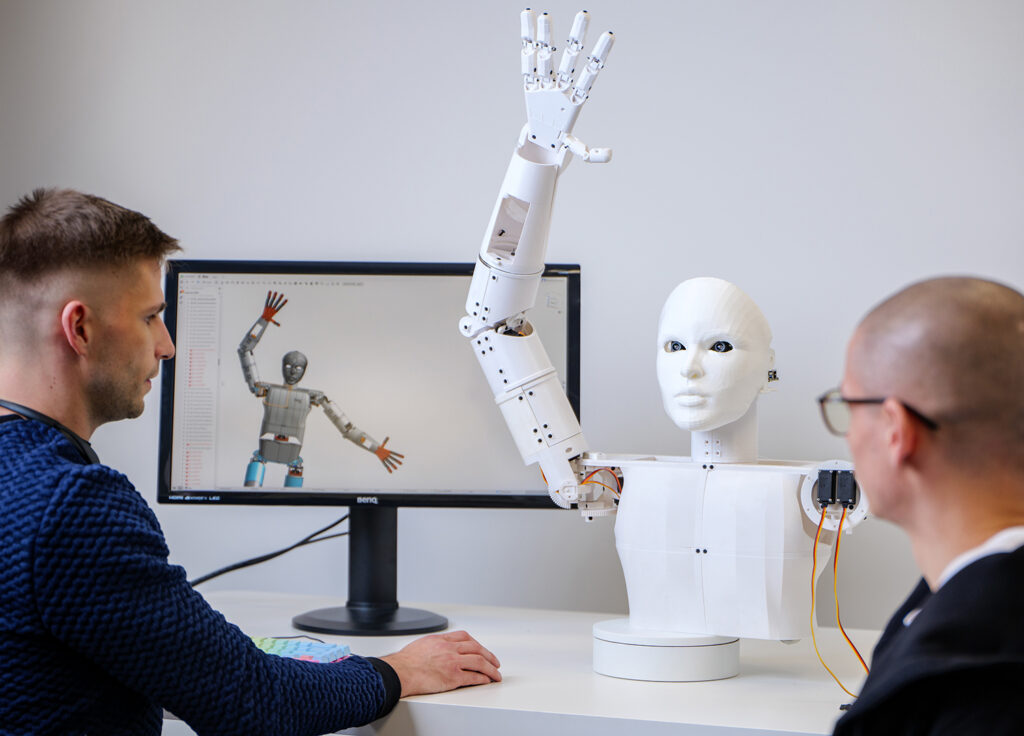

Featuring numerous web-based editing software and a wide array of sensors, RobotCreator DX can be programmed to perform complicated tasks including voice recognition, video calls, interactive games, and many more.

Thanks to the advanced RoFlow Workflow interface, users can effortlessly program the robot to perform various tasks without prior coding knowledge. On the other hand, Trainkit allows users to train DX to chat and respond with physical motions, images or videos.

Notable features include:

- Roflow: A powerful cloud-based visual programming software that allows users to easily customize the robot’s behavior. Users can tap into the vast resources and functions of the robot without prior programming skills.

- CodeLab: An easy-to-use coding center for RobotCreator DX. CodeLab can be accessed from computers, mobile devices, or the DX itself. Natively supports MQTT, CodeLab allows for cross-device control and connection.

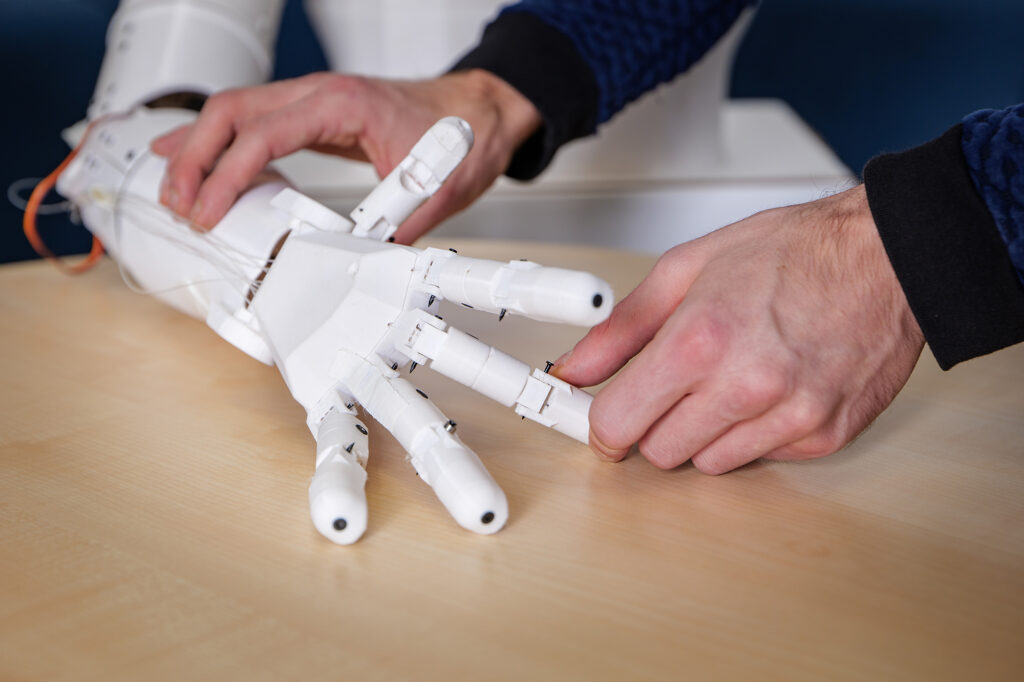

- Content Editor: A timeline-based motion editing software designed to program the robot to perform sophisticated movements with its built-in expression and movement library.

- Trainkit: A chatbot dialogue design tool with fuzzy language matching. Trainkit allows users to add body movement, as well as images or videos to the response.

- Quiz Editor: Quiz Editor allows users to design and create interactive games where the fun never ends. Interaction can be made using the integrated touch and audio sensors.

- Skin Editor: A web-based editing software that allows users to create dynamic facial expressions for RobotCreator DX. Users can utilize the built-in templates or create their own with Adobe Photoshop or Illustrator.

- MakerBase: As one of the pillars of the NUWA platform, users can connect with DX fans across the world and share resources like the code, design, and more.

RobotCreator DX Pricing and Availability

Early Bird pledges for RobotCreator DX are now available for a limited amount on Kickstarter for $599, which is more than 40% off the future retail price.

For the complete list of all available backing options and more product details, jump over to the official RobotCreator DX crowdfunding campaign page by clicking the link below.

About NUWA

Founded in Taipei, Taiwan in 2016, NUWA Robotics has extensive experience in AI, software/hardware development, interactive content, and mass production. We have experts across different fields to design and create a robot that can establish a deeper connection with humans. NUWA envisions a world where everyone has a robot companion that provides beyond just responses to commands, but one that can support emotional needs.