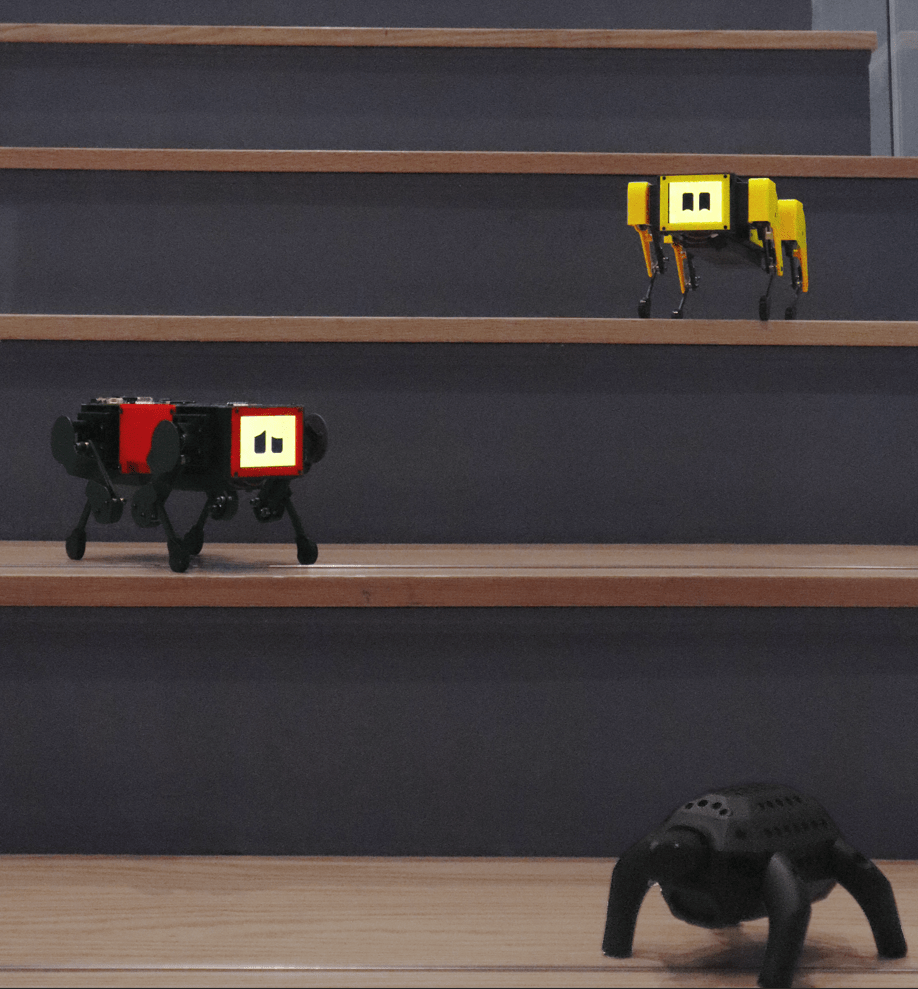

Das Kickstarter-Projekt „MD Robot Kit: Unlock your AI Robot Engineering Dream Job“ von MangDang zielt darauf ab, die Kreativität und das technische Know-how von Robotik-Enthusiasten zu fördern. Es bietet zwei Hauptroboter, die jeweils unterschiedliche Bedürfnisse und Interessen ansprechen.

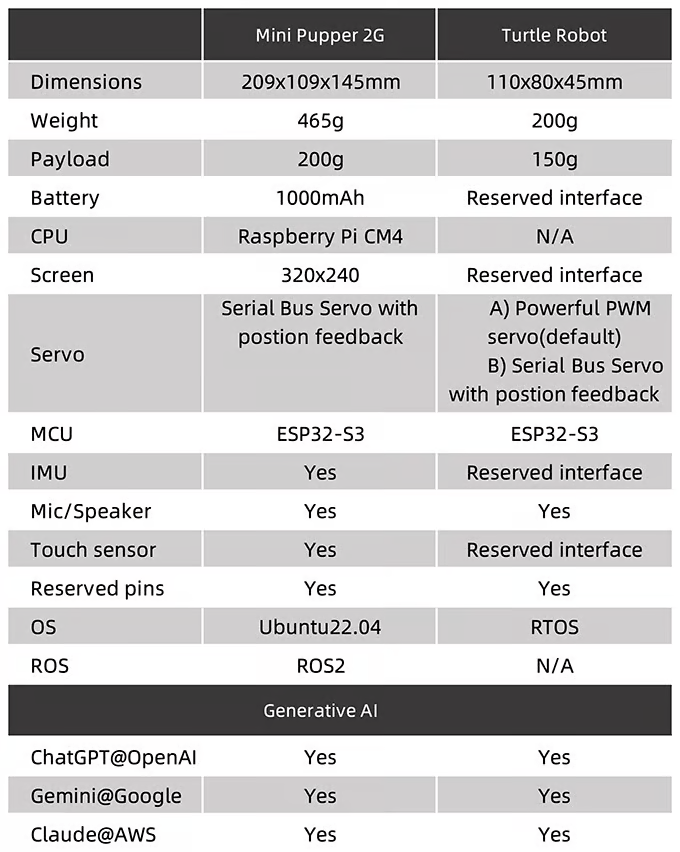

Der erste Roboter, der Mini Pupper, ist in mehreren Versionen erhältlich, darunter Mini Pupper 1, Mini Pupper 2 sowie die Modelle 2G und 2GA. Dieser Roboter ist ein kostengünstiges, persönliches Quadruped-Kit, das mit Open-Source-Software ausgestattet ist. Der Mini Pupper unterstützt multimodale generative KI-Plattformen wie ChatGPT von OpenAI, Gemini von Google und Claude von AWS. Zudem ist er mit ROS1 und ROS2 kompatibel, was seine Fähigkeiten in den Bereichen SLAM (Simultaneous Localization and Mapping) und Navigation erweitert. Die Integration von OpenCV ermöglicht es dem Roboter, Deep Learning mit Kameras durchzuführen. Dank der Nutzung von Raspberry Pi und Arduino bietet der Mini Pupper eine hohe Anpassungsfähigkeit und Erweiterbarkeit, was ihn ideal für Entwickler macht, die ihre eigenen Projekte realisieren möchten.

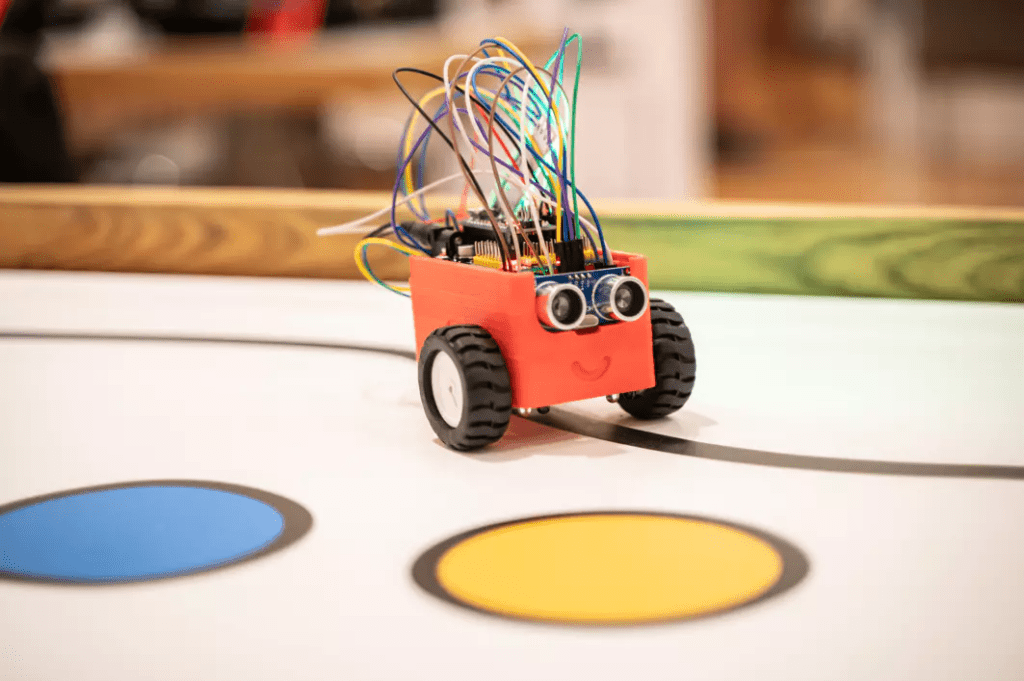

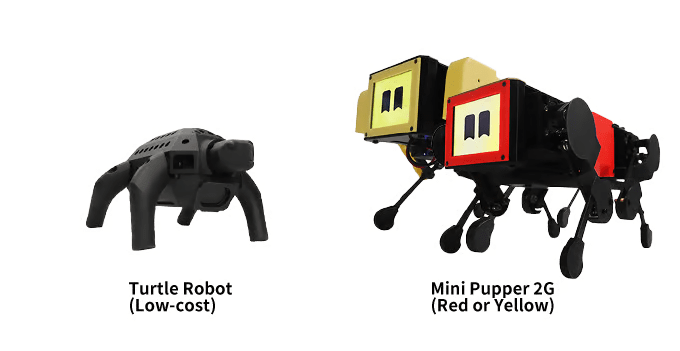

Der zweite vorgestellte Roboter ist der Turtle Robot, der bald verfügbar sein wird. Dieser Roboter richtet sich speziell an Schulen, Homeschooling-Familien und Roboter-Enthusiasten. Während detaillierte Spezifikationen noch nicht vollständig veröffentlicht wurden, ist klar, dass der Turtle Robot ebenfalls darauf abzielt, das Lernen und die Kreativität im Bereich der Robotik zu unterstützen.

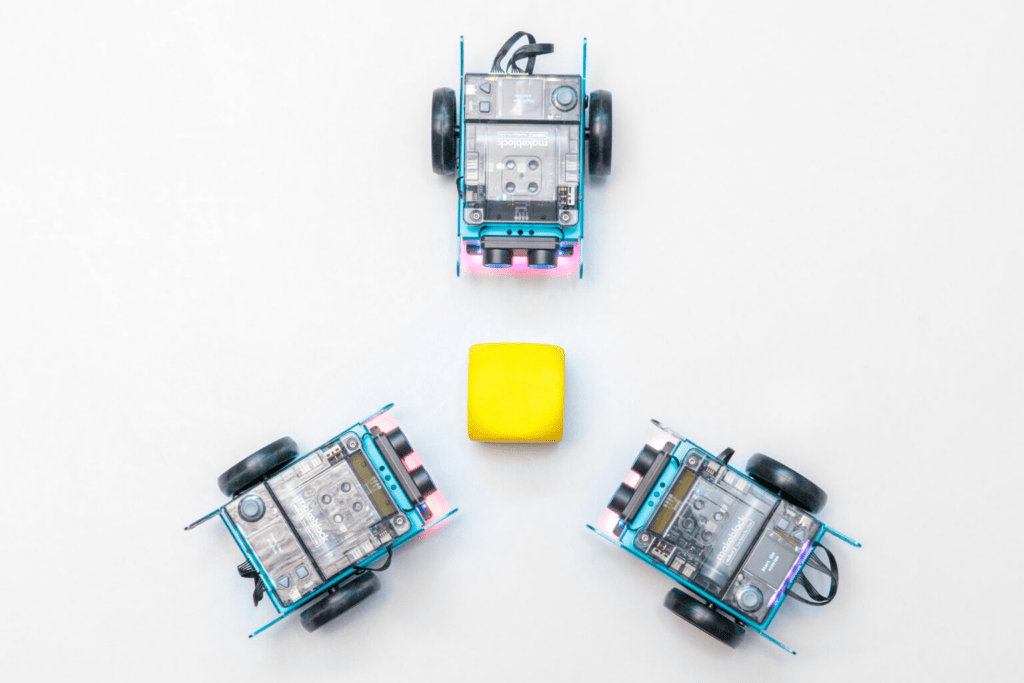

Die Kampagne selbst hat ein Finanzierungsziel von 9000€ gesetzt und dieses mit einer erreichten Summe von knapp 19000€ , was über 200% des ursprünglichen Ziels entspricht, deutlich übertroffen. Die Kampagne läuft vom 5. September 2024 bis zum 5. Oktober 2024 und zog bisher 80 Unterstützer an. Ein herausragendes Merkmal der MD Robot Kits ist ihre Open-Source-Natur, die es den Nutzern ermöglicht, die Roboter in weniger als einer Stunde zusammenzubauen. Dies macht sie besonders zugänglich für eine breite Zielgruppe, die von Bildungseinrichtungen bis hin zu DIY-Enthusiasten reicht. Das Projekt ist darauf ausgelegt, nicht nur technisches Wissen zu vermitteln, sondern auch die Freude an der Schaffung und Anpassung von Robotern zu fördern.

Roboter

1. Mini Pupper:

- Versionen: Mini Pupper 1 (2021), Mini Pupper 2 (2022), Mini Pupper 2G & 2GA.

- Design: Ein kostengünstiges, persönliches Quadruped-Kit mit Open-Source-Software.

- Funktionen: Unterstützt multimodale generative KI wie ChatGPT von OpenAI, Gemini von Google und Claude von AWS. Es ist kompatibel mit ROS1 und ROS2 für SLAM & Navigation und basiert auf OpenCV für Deep Learning mit Kameras.

- Erweiterbarkeit: Nutzt Raspberry Pi und Arduino, was hohe Anpassungsfähigkeit ermöglicht.

- Open-Source-Plattform: Der Mini Pupper unterstützt das Robot Operating System (ROS) und bietet Funktionen wie SLAM (Simultaneous Localization and Mapping) und Navigation. Er ist mit Lidar- und Kamerasensoren ausgestattet, die es ihm ermöglichen, seine Umgebung zu kartieren und sich autonom zu bewegen.

- Technische Spezifikationen: Der Roboter verfügt über 12 Freiheitsgrade, die durch fortschrittliche Servomotoren ermöglicht werden. Diese Motoren bieten Feedback zu Beschleunigung und Kraft, was eine präzise Steuerung erlaubt.

- Hardware und Erweiterbarkeit: Der Mini Pupper nutzt den Raspberry Pi 4B oder das Raspberry Pi Compute Module 4 als zentrale Recheneinheit und ist mit einem ESP32 als Mikrocontroller ausgestattet. Er verfügt über ein IPS-Display mit einer Auflösung von 240 x 320 Pixeln, ein Mikrofon, Lautsprecher und einen Touch-Sensor.

- Anpassungsfähigkeit: Dank seiner Open-Source-Natur kann der Mini Pupper tiefgreifend modifiziert werden. Nutzer können eigene Module hinzufügen und den Roboter für verschiedene Projekte anpassen, wie z.B. das Verfolgen von Objekten im Raum.

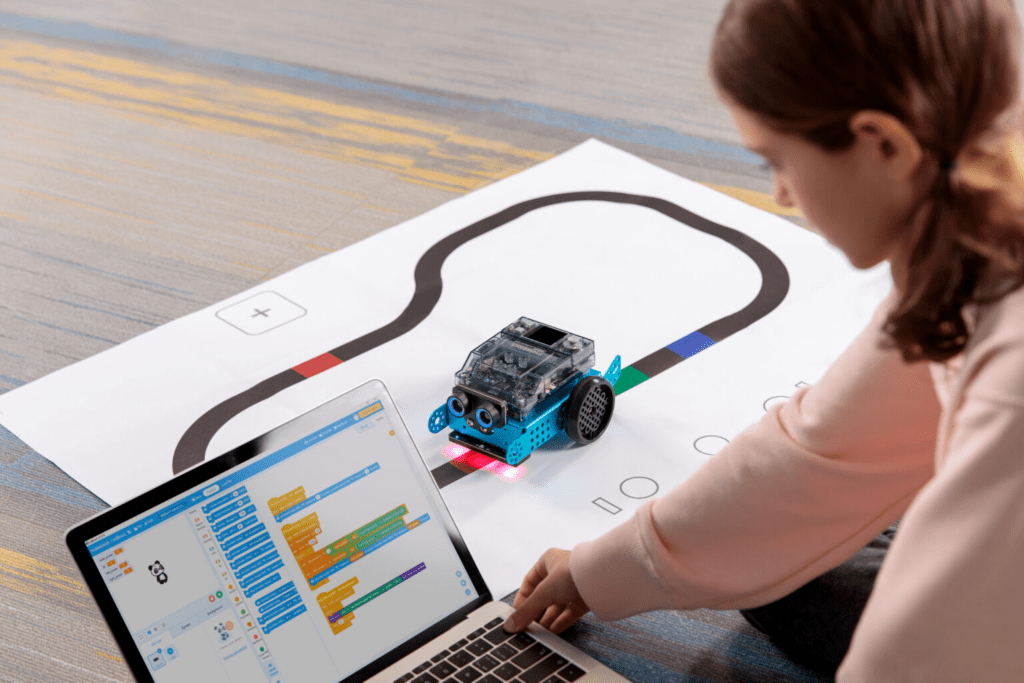

- Bildung und Community: Der Mini Pupper ist ideal für Schulen und Homeschooling-Familien geeignet. Er wird mit umfassenden Anleitungen und Ressourcen geliefert, die den Einstieg in die Robotik erleichtern. Nutzer können Teil einer globalen Community werden, um Ideen auszutauschen und Unterstützung zu erhalten.

- Preis und Verfügbarkeit: Im Rahmen der Kickstarter-Kampagne wird der Mini Pupper in verschiedenen Versionen angeboten, wobei das Basismodell etwa 479 Euro kostet. Die Auslieferung soll im Februar beginnen, wobei Unterstützer das finanzielle Risiko von Crowdfunding-Kampagnen beachten sollten.

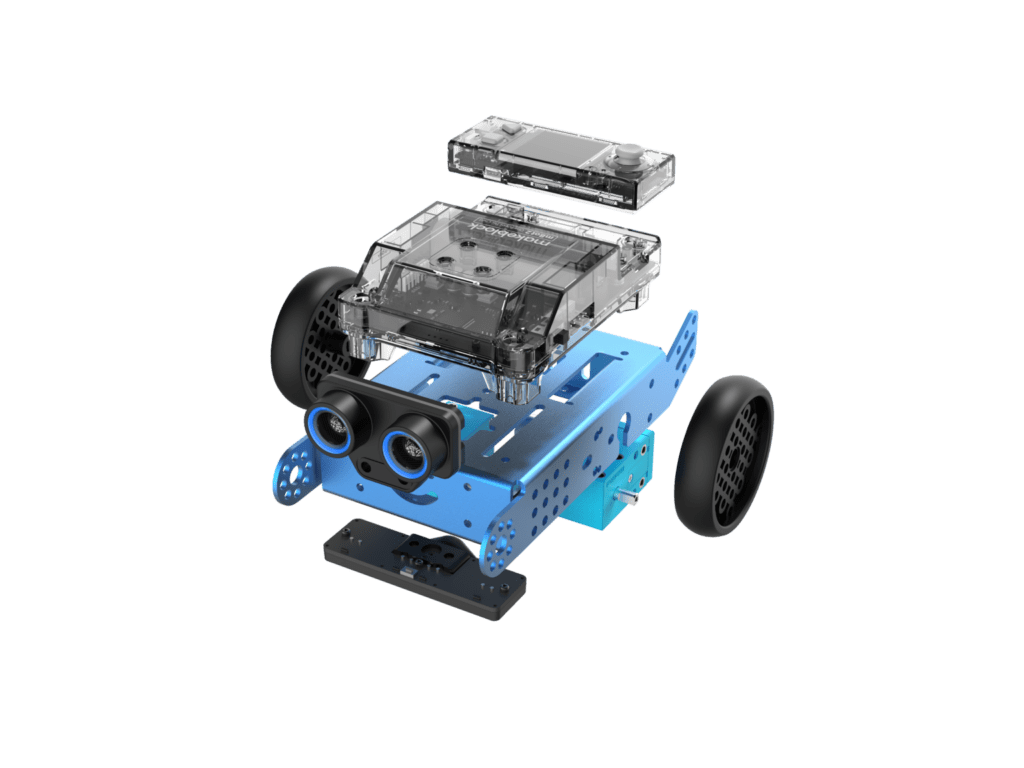

2. Turtle Robot:

- Open-Source-Projekt: Der Turtle Robot basiert auf Arduino und ist ein Open-Source-Projekt, das die Integration von generativer KI unterstützt. Dies ermöglicht den Nutzern, den Roboter individuell anzupassen und zu erweitern.

- Erschwinglichkeit: Der Turtle Robot ist eine kostengünstige Lernplattform für multimodale generative KI und wird zu einem Einführungspreis von 60% Rabatt auf 99 US-Dollar angeboten. Dies macht ihn besonders attraktiv für Bildungseinrichtungen und DIY-Enthusiasten.

- Benutzerfreundlichkeit: Der Roboter ist so konzipiert, dass er innerhalb einer Woche aufgebaut und in Betrieb genommen werden kann. Dies erleichtert es Anfängern, schnell mit dem Lernen und Experimentieren zu beginnen.

- Unterstützung und Ressourcen: MangDang bietet umfassende Unterstützung über verschiedene Kanäle sowie Zugang zu allen Code- und Design-Dateien über ein GitHub-Repository. Nutzer können die STL-Design-Dateien ausdrucken und ihre eigenen Ideen einbringen.

- Multimodale Generative KI: Der Turtle Robot nutzt fortschrittliche KI-Technologien, die kontinuierliche Sprachinteraktionen ermöglichen. Die KI kann sich an frühere Gespräche erinnern und darauf basierend personalisierte Antworten geben.

- Anwendungsbeispiele: Es gibt zwei Arduino-Projekte, die mit dem Turtle Robot genutzt werden können: eines zum Testen einzelner Funktionen und ein weiteres, das alle Funktionen über Sprachsteuerung ausführt.

- Verfügbarkeit: Der Turtle Robot war im Rahmen der Kickstarter-Kampagne bis Oktober 2024 erhältlich und wird danach in einem Online-Shop verfügbar sein.