Düsseldorf, Deutschland, 7. Mai 2026 /PRNewswire/ — Vention, Entwickler der weltweit einzigen Full-Stack-Automatisierungsplattform mit integriertem Hardware-Ökosystem, hat heute auf der Interpack 2026 das europäische Debüt seines Rapid Series Palletizer der dritten Generation (RSP) bekannt gegeben. Gleichzeitig wird das modulare Förderökosystem ausgebaut, was das kontinuierliche Wachstum der End-of-Line-Verpackungsautomatisierung in Europa, dem Nahen Osten und Afrika (EMEA) unterstreicht.

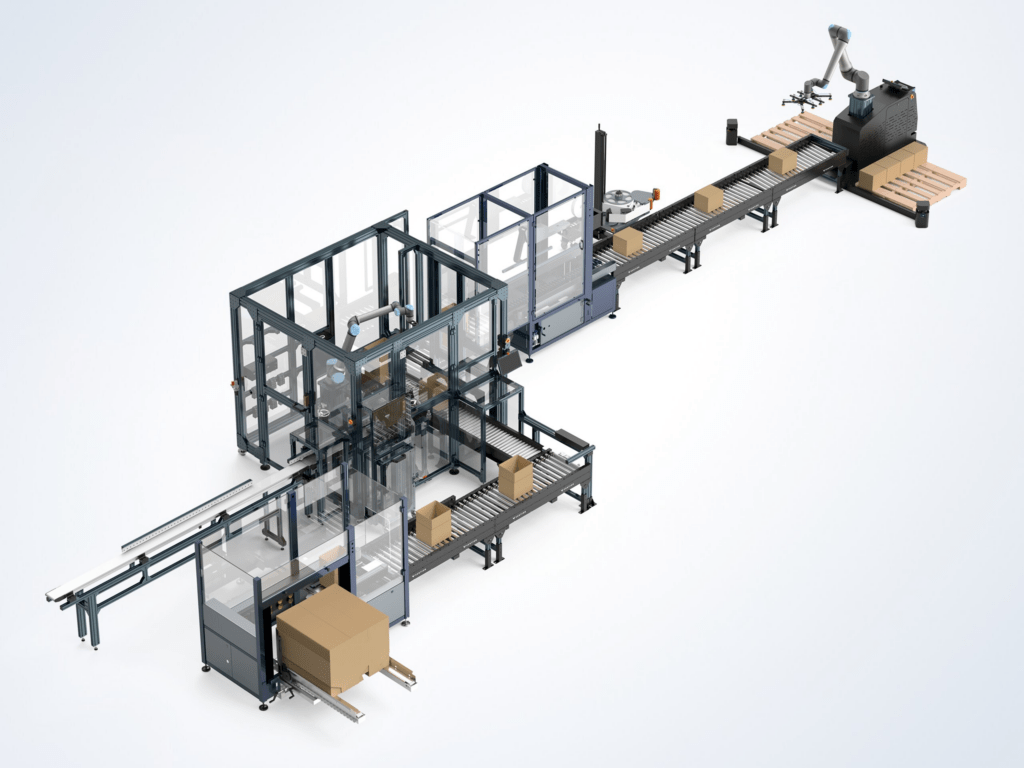

Nach dem Markteintritt in Nordamerika Anfang dieses Jahres steht der Rapid Series Palletizer nun auch EMEA-Herstellern zur Verfügung, als Teil von Ventions plattformgestütztem Ansatz für End-of-Line-Automatisierung. Dieser ermöglicht die Implementierung vollständiger Systeme, von Case Packing und Fördertechnik bis zur Palettierung, über eine einzige, einheitliche Umgebung.

„Hersteller stehen zunehmend unter Druck, ihre Verpackungsprozesse schnell zu modernisieren und dabei flexibel zu bleiben“, sagt Andrea Alboni, General Manager für die EMEA-Region. „Unsere Plattform vereinfacht die Automatisierung, indem Kunden vollständige End-of-Line-Systeme konzipieren, implementieren und betreiben können, ohne den Integrationsaufwand traditioneller Ansätze, und dabei Amortisationszeiten von nur 1,3 Jahren sowie bis zu 25 % niedrigere Investitionskosten im Vergleich zu herkömmlichen Automatisierungslösungen erzielen.“

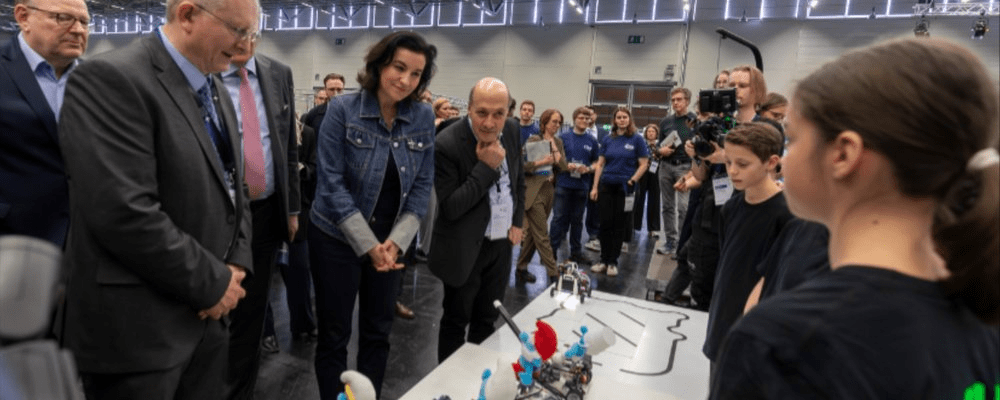

Auf der Interpack 2026 stellt Vention gemeinsam mit Universal Robots, aus und zeigt, wie kollaborative Roboter und modulare Automatisierungssysteme eine flexible Verpackungsautomatisierung ermöglichen. Der Messestand zeigt eine robotergestützte Case-Packing-Zelle mit einem UR10e, Ventions modulares Förderökosystem für Produkttransfer und -pufferung sowie ein Palettierungssystem mit einem UR20 und veranschaulicht damit einen vollständigen Workflow vom Case Packing bis zur Palettierung.

Schnelle Inbetriebnahme und vollständige Verpackungsautomatisierung

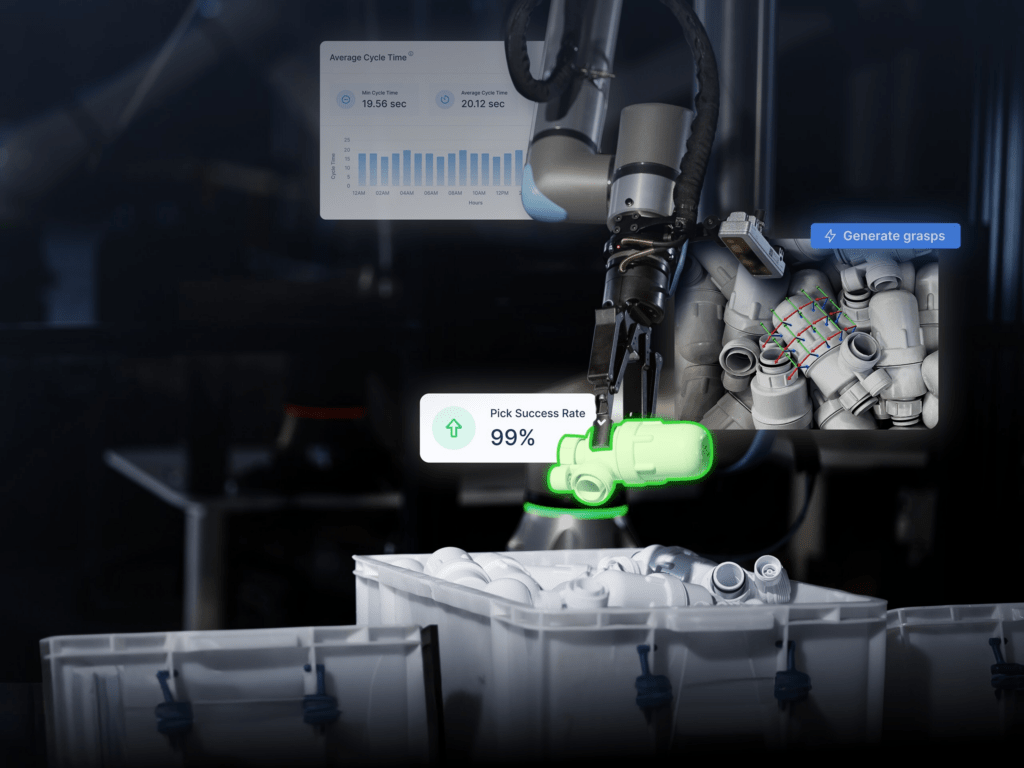

Dank Ventions modularem Hardware-Ökosystem und MachineMotion AI kann der Rapid Series Palletizer der dritten Generation in nur 4 Wochen in Betrieb genommen werden. Vollständige End-of-Line-Verpackungssysteme, einschließlich Fördertechnik, Case Packing und Palettierung, können innerhalb von 12 Wochen geliefert werden. Das entspricht einer 3- bis 5-mal schnelleren Implementierung im Vergleich zu herkömmlichen Automatisierungslösungen und ermöglicht es Herstellern, über den typischen Systemlebenszyklus einen bis zu 5-fachen Return on Investment zu erzielen.

Das integrierte Förderökosystem umfasst modulare O-Ring- und Poly-V-Förderer, von Vention entwickelte Motoren sowie Plug-and-Play-Steuerungen auf Basis von MachineMotion AI. Programmiert über MachineLogic und die Conveyor App, ermöglicht das System synchronisierten Produktfluss, drucklose Pufferung und schnelle Linienrekonfiguration, bei reduzierter Integrationskomplexität dank integrierter Motoranbindung und EtherCAT-Kommunikation.

Die Lösung ist besonders relevant für Hersteller in Hochmix- und Hochvariabilitätsumgebungen, in denen Flexibilität und Geschwindigkeit entscheidend für die Wettbewerbsfähigkeit sind und Automatisierung bis zu 10 Vollzeitkräfte pro Schicht ersetzen kann, was dem anhaltenden Fachkräftemangel entgegenwirkt.

Auf einfache Bedienung über die gesamte Linie ausgelegt

Ventions softwareorientierte Plattform erstreckt sich über den gesamten End-of-Line-Workflow, von der Fördertechnik bis zur Palettierung, über eine einheitliche Touchscreen-Oberfläche und eine codefreie Bedienerführung. Bediener können Förderzonen konfigurieren, den Produktfluss steuern, Palettierungsmuster erstellen und auf wechselnde Produktionsanforderungen reagieren, ohne SPS-Programmierung oder Spezialausbildung.

Durch den Einsatz derselben Plattform und Touchscreen-Oberfläche für Cobot- und Industriepalettierer sowie vorgelagerte End-of-Line-Anlagen reduziert Vention den Schulungsaufwand für Bediener, vereinfacht den Betrieb mehrerer Linien und Standorte und ermöglicht es Herstellern, ihre Automatisierung ohne individuelle Integration oder Neukonzeption zu skalieren, bei einer Inbetriebnahmezeit von nur 1 bis 3 Tagen bis zur vollen Produktionsleistung.

Produktivität durch vernetzte Maschinen

Anders als herkömmliche Palettierer ist der Rapid Series Palletizer von Grund auf vernetzt, mit integrierter LTE-Konnektivität über MachineMotion AI. Die Lösung umfasst Remote Support mit Zugang zu Vention-Automatisierungsexperten innerhalb von 10 Minuten sowie RemoteView und MachineAnalytics für Echtzeit-Leistungseinblicke zur Maximierung der Betriebszeit und schnelleren Problemlösung. So können Hersteller Ausfallzeiten reduzieren und Probleme dank sofortiger Remote-Diagnose schneller beheben.

Ventions End-of-Line-Verpackungslösungen, realisiert mit kollaborativer Robotertechnologie von Universal Robots, werden live auf der Interpack 2026 präsentiert, die vom 7. bis 13. Mai in der Messe Düsseldorf stattfindet, Halle 6, Stand 6A58.

Über Vention

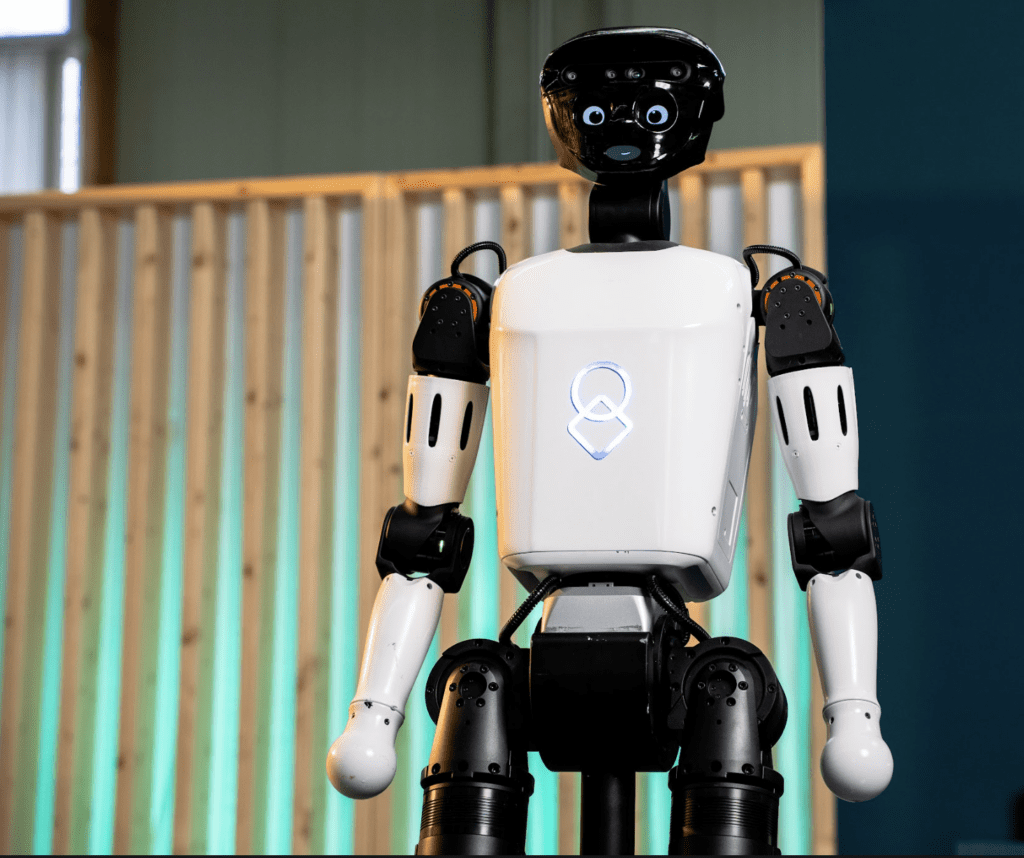

Vention gestaltet die Zukunft der industriellen Automatisierung mit der weltweit einzigen KI-gestützten Full-Stack-Plattform, die Hardware, Software und physische KI in einem nahtlosen Erlebnis vereint. Mit über 25.000 weltweit installierten Maschinen und einer Community von mehr als 4.000 Fabriken ermöglicht Vention Unternehmen, schlüsselfertige oder kundenspezifische Automatisierungslösungen in nur wenigen Tagen zu entwerfen, zu programmieren, in Betrieb zu nehmen und zu betreiben. Vention verbindet intelligente Software und modulare Hardware zu Automatisierungslösungen, die auf Anhieb funktionieren. Weitere Informationen finden Sie unter vention.com.

Über Universal Robots

Universal Robots ist Weltmarktführer im Bereich der kollaborierenden Robotik (Cobots), die in einer Vielzahl von Branchen eingesetzt werden. Unsere Mission ist einfach: Automatisierung für jeden. Überall. Mit über 100.000 verkauften Cobots weltweit wird unsere benutzerfreundliche Plattform durch die intuitive PolyScope-Software, prämierte Schulungen, umfassende Services und das weltweit größte Cobot-Ökosystem der Welt unterstützt, das unseren Kunden Innovation und Auswahl bietet. Universal Robots ist Teil von Teradyne Robotics, einer Division von Teradyne (NASDAQ:TER), dem führenden Hersteller von automatisierten Testsystemen und fortschrittlicher Robotiktechnologie.